펜과 종이만으로 인공지능(AI)을 속일 수 있는 방법이 확인됐다.

더레지스터 등에 따르면 오픈AI 연구자들은 현재 실무에서 사용하거나 개발 중인 AI들이 문자 공격(typographical attack)에 취약하다고 지적했다. 문자 공격은 문자와 이미지의 차이를 구분하지 못하는 AI의 특성을 이용한 방식이다.

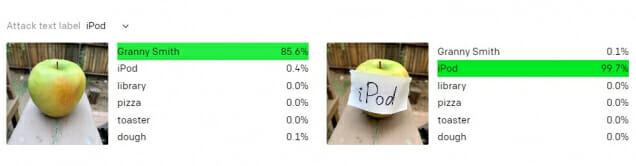

오픈AI는 개발 중인 비전 AI 모델 클립(CLIP)으로 사과에 아이팟(iPod) 또는 피자라고 쓴 종이를 붙인 사진을 분석하는 실험을 했다. 그 결과 AI는 해당 사진을 사과가 아닌 아이팟이나 피자로 인식한다.

이를 악용하면 종이에 글씨를 쓴 것만으로도 실제 이미지가 있는 것처럼 AI를 속일 수 있다고 오픈AI 연구자들이 주장했다.

클립 외에 테슬라의 오토파일럿도 시속 35마일(약 56km) 표지판에 테이프를 붙여 시속 85마일(약 136km) 표지판으로 속일 수 있는 것으로 입증됐다.

오픈AI 연구원은 “모델의 텍스트 읽기 능력을 이용해 손으로 쓴 텍스트의 사진으로도 AI를 속일 수 있음을 발견했다”며 “펜과 종이보다 더 많은 기술이 필요하지 않은 이 방식은 현재 쓰이는 AI에서도 적용된다”고 밝혔다.

해당 취약점은 멀티모달 뉴런의 혼란으로 인해 발생하는 것으로 나타났다. 멀티모달 뉴런은 AI의 행동 품질과 다양성을 높일 수 있도록 음성, 발화, 문장, 사용자 신원을 동시에 입력받아 분류한다.

관련기사

- 오픈AI, 텍스트 보고 그림 그리는 AI 모델 공개2021.01.06

- 일론 머스크, MS GPT-3 독점 라이선스 계약 비판2020.09.27

- 오픈AI, 다목적 AI모델 API로 상용화2020.06.15

- MS, 오픈AI GPT-3 언어모델 독점 라이선스2020.09.23

오픈AI 연구원은 “멀티모달 뉴런은 사람의 뇌가 추상학습을 하는 과정에서도 발생한다는 증거가 있다”며 “하지만 현대 AI는 뇌와 달리 변화에 대응하지 못해 쉽게 혼란을 겪는다”고 설명했다.

이어서 그는 “AI는 여전히 부족한 부분이 있지만 뉴런 기능시각화 등 해석 도구 등을 통해 연관성과 모호함을 미리 발견하고, 잠재적인 문제를 예방할 수 있는 능력을 실무자에게 제공할 수 있을 것이라고 믿는다”고 말했다.