머신러닝(기계학습) 업체 오픈AI가 제시된 텍스트를 보고 이미지를 창작해 그릴 수 있는 새로운 AI 모델을 공개했다.

5일(현지시간) 악시오스, 벤처비트 등 IT 전문 외신에 따르면 이날 오픈AI는 컴퓨터 비전과 자연어처리(NL) 기술을 결합해, 텍스트에서 이미지를 생성할 수 있는 새로운 AI 모델 'DALL-E'를 공개했다.

오픈AI 공동창업자 겸 최고과학자 일리아 수츠케버는 DALL-E에 대해 "어떤 텍스트가 주어져도 그것을 가지고 이미지를 만들 수 있는 뉴럴네트워크(신경망)"라고 소개했다.

DALL-E라는 이름은 초현실 주의 화가 살바도르 달리(Salvador Dali)와 로봇 애니메이션 속 로봇 캐릭터 윌-E(WALL-E)에서 따왔다.

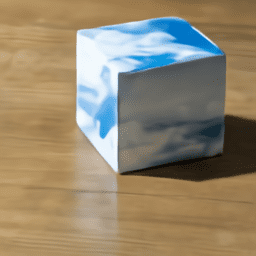

오픈AI는 DALL-E 모델로 생성한 다양한 이미지도 함께 공개했다. 여기에는 '개와 산책하고 있는 튜튜(발레 치마)를 입은 아기 무 일러스트', '파란색 딸기 이미지가 있는 스테인글라스 창'. 클라우드 큐브' 등의 텍스트에서 생성한 다양한 이미지가 포함됐다.

공개된 테스트 이미지를 살펴보면 DALL-E가 생성된 형상에서 오브젝트(객체)를 능숙하게 조종하고 재배열할 수 있는 능력을 갖췄고, 또 질감이나 입체감처럼 제시되지 않은 부분까지 표현해 낼 수 있는 것으로 보인다.

DALL-E는 또 사진, 일러스트, 예술가의 작품 같은 다양한 표현 방식으로 이미지를 생성할 수 있다.

오픈AI는 이날 적은 데이터만 가지고 훈련해도 높은 정확도로 이미지를 식별하고, 사진에 캡션을 붙일 수 있는 새로운 신경망 모델 '클립(CLIP)'도 소개했다. CLIP은 오픈AI가 앞서 공개한 GPT-2, GPT-3 언어 모델과 유사하게, 적은 데이터로 효율적인 학습이 가능한 '제로 샷 러닝'을 적용했다.

악시오스는 새로운 AI 모델에 대해 "오픈AI가 (모델 학습에 필요한)컴퓨팅 비용을 줄이면서, 현실에서 실제 유용한 작업을 수행하는 일반 지능 요소를 갖춘 시스템을 만들기 위해 지속적으로 노력하고 있다는 점을 보여준다"고 평가했다.