정부가 오는 22일 인공지능(AI)기본법 시행을 앞두고 AI 투명성 기준을 구체화했다. AI 생성물에 대한 사회적 신뢰를 높이고 현장 혼선을 줄이겠다는 취지다.

과학기술정보통신부는 AI기본법 제31조에 규정된 투명성 확보 의무의 세부 이행방안을 담은 'AI 투명성 확보 가이드라인'을 공개했다고 21일 밝혔다.

AI기본법은 AI 산업을 체계적으로 육성하고 안전한 활용 기반을 조성하기 위해 지난해 1월 21일 제정됐다. 다만 정부는 최소 1년 이상의 계도기간을 운영해 해당 기간 동안 투명성 조항에 대한 사실조사와 과태료 부과를 유예한다.

이번 가이드라인은 그동안 법률과 시행령만으로는 투명성 확보 의무 적용 기준을 파악하기 어렵다는 업계 우려를 반영해 마련됐다. 과기정통부는 지난해 9월 초안을 공개한 뒤, 실제 운영 중인 AI 제품·서비스 유형을 기준으로 이행 기준을 정리했다.

가이드라인은 투명성 확보 의무의 적용 대상을 이용자에게 AI 제품·서비스를 직접 제공하는 'AI사업자'로 명확히 했다. 국내 이용자 대상으로 서비스 제공하는 해외 사업자도 대상에 포함된다.

AI를 업무나 창작의 도구로 활용하는 이용자는 의무 대상에서 제외됐다. 예를 들어 영상 생성 AI를 활용해 영화를 제작·배급하는 제작사는 AI 제품·서비스 제공자가 아니라 이용자에 해당한다.

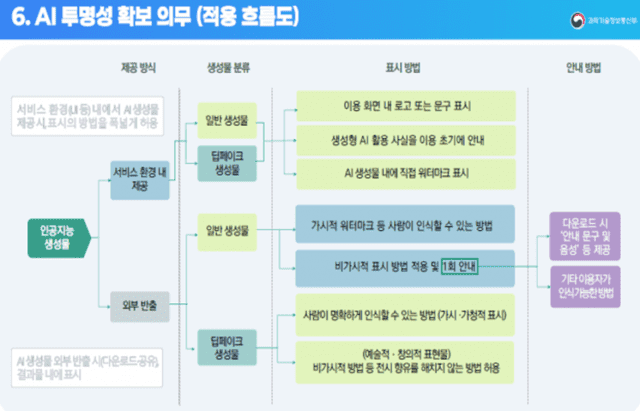

투명성 확보 의무는 고영향 또는 생성형 AI 기반 운용 사실 사전 고지와, AI 생성물 표시 의무로 나뉜다. 서비스 환경 내에서만 제공되는 생성물은 화면 안내, 로고 표출 등 유연한 표시가 허용된다. 다만 외부로 반출되는 경우 사람이 인식할 수 있는 표시나 메타데이터 적용이 요구된다.

관련기사

- 정부, AI기본법 시행 임박…"AI 산업 진흥·신뢰 우선"2026.01.21

- 정부 "AI기본법, 위험 대비 제도일 뿐…과도 규제 아냐"2026.01.21

- [AI기본법 시행①] 韓, '세계 최초' 타이틀…"해외 기업과 역차별 없어야"2026.01.19

- [AI 기본법 시행②] "준비만이 살 길"…대기업·스타트업·협단체 대응 총력2026.01.20

특히 실제와 구분하기 어려운 가상 생성물에 대해서는 사람이 명확히 인식할 수 있는 표시를 반드시 적용하도록 했다. 사회적 우려가 큰 영역에 대해 보다 엄격한 기준을 적용한 셈이다.

과기정통부는 "AI 생성물에 대한 워터마크 적용은 딥페이크 오용 등 기술 부작용을 막기 위한 최소 안전장치이자 이미 주요 글로벌 기업들이 도입하고 있는 세계적인 추세"라고 밝혔다.