“인공지능(AI) 시대가 다가오면서 기대와 두려움이 교차하고 있다. AI 윤리에 대한 방향성을 제시하기 위해 공적 기관의 역할이 중요하다.”

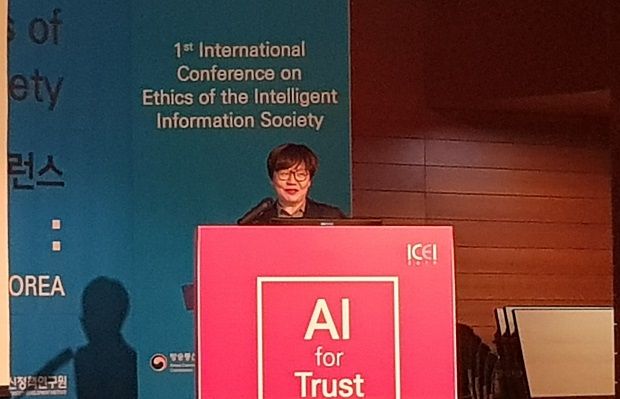

5일 서울 중앙우체국에서 열린 ‘2019 지능정보사회 이용자 보호 국제 컨퍼런스’에서 발표를 맡은 이호영 정보통신정책연구원 연구위원은 이같이 말했다.

이호영 연구위원은 AI가 사회 전반에 확산될수록 불확실성이 커지고 있다고 설명했다. AI를 통해 생활편의가 개선될 것이라는 기대와 경제·사회·윤리 측면에서 인간이 배제될 것이란 두려움이 불확실성을 키운다는 설명이다.

이 연구위원은 “이용자들은 AI가 일자리를 빼앗거나, AI 알고리즘이 면접에 앞서 서류를 거절하게 될 것이란 두려움을 갖고 있다”며 “반면, 한편으로는 데이터 기반의 AI가 인류의 난제 해결에 도움을 줄 것이란 기대도 동시에 갖고 있다”고 말했다.

불확실성은 ‘AI 윤리’가 필요하다는 주장으로 이어진다. AI가 불러올 악영향을 최소화하기 위해 사전적으로 AI를 규정할 필요가 있다는 뜻이다.

AI 윤리에 대한 고민은 ‘성능 극대화’와 ‘윤리를 위한 제한’ 사이에 머물러있다. 사회 문제를 해결하기 위해서는 규제를 최소화해야 하지만, 윤리적인 측면을 포함하려면 규제가 생길 수밖에 없기 때문이다.

관련기사

- SKT, 책 읽어 주는 ‘AI 스피커 서비스’ 출시2019.12.06

- 산업에 인공지능(AI) 적용위해 산학연 머리 맞댄다2019.12.06

- KT, AI로 교량 위험도 미리 측정한다2019.12.06

- NHN 바둑 AI ‘한돌’, 이세돌 9단과 겨룬다2019.12.06

이호영 위원은 AI 윤리의 방향성을 정하기 위해 공적 기관의 역할이 중요하다고 강조했다. 이호영 위원은 “윤리 프레임워크는 연구하는 시각에 따라 변화가 이뤄지고 있다”며 “이를 결정하는 것이 공적 기관의 역할”이라고 말했다.

이어 “결국에는 AI 이용자가 수동적이지 않고. 적극적으로 나서면서 중요한 지능정보화사회의 중요한 요소가 되는 것이 핵심”이라고 덧붙였다.