구글의 새로운 딥러닝(심층 학습) 시스템 ‘플래닛’(PlaNet)은 이미지에서 거리의 풍경이나 실내 물체의 촬영 위치를 확인하는 작업에 있어 인간의 능력을 능가한다.

구글은 모든 사진을 분석해 그 촬영 장소를 정확하게 파악하는 능력을 얻은 셈이다. 플래닛의 개발 팀에 따르면이 기계는 ‘인간 이상의 정밀도’를 자랑한다.

24일(현지시간) MIT 테크놀로지 리뷰에 따르면 구글의 신경망 분야에서 개발되고 있는 플래닛은 이미지의 픽셀만을 사용해 이 작업을 수행한다.

이 프로젝트를 주도하는 것은 구글의 컴퓨터 비전 전문가인 토비아스 웨이얀드 씨다. 웨이얀드 씨의 최신 논문에 따르면 연구팀은 '구글+'에서 취득한 위치 정보 태그(Exif 위치 정보) 데이터와 이미지 메타 데이터를 포함한 대량의 이미지 데이터 세트를 사용해 회선 신경망에 학습 시켰다.

웨이얀드 씨는 논문에 따르면 과거에는 대략적인 위치를 제시할 수 밖에 없었다. 그러나 플래닛은 날씨 패턴과 식물, 노면 표지, 건축물의 세부 사항 등 여러 시각적 단서를 사용해 정확한 위치를 특정할 수있다.

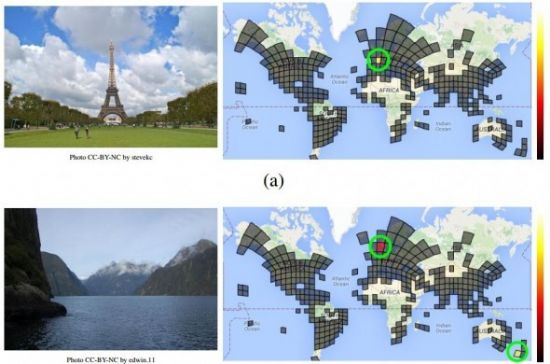

이 접근 방식으로 플래닛은 사진에 대해 “확신이 없음”을 표현하는 것도 가능하다. 예를 들어 에펠 탑 사진 촬영 장소에 대해서는 상당한 자신감을 보여 주지만, 피오르(빙식곡이 침수해 생긴 좁고 깊은 후미) 이미지에 관해서는 뉴질랜드와 노르웨이 모두의 가능성을 제시한다.

이 시스템은 세계를 2만6천개의 사각형으로 이뤄진 바둑판 무늬로 분할해 개발됐다. 일정한 장소에서 촬영된 이미지가 많을수록 해당 위치의 사각형이 확장하기 때문에 도시는 소외 지역보다 크다. 한편 바다는 완전히 무시되고 있다.

관련기사

- 구글 인공지능, 헬스케어 시장까지 넘본다2016.02.26

- 구글, 뉴스 사이트 대상 DDoS 막는 '프로젝트 실드' 가동2016.02.26

- 프랑스, 구글에 2조1천억 과세 방침2016.02.26

- 구글독스에 음성 편집 기능도 추가2016.02.26

네트워크 학습시키기 위해 구글은 웹에서 취득한 Exif 이미지 메타 데이터를 포함 1억2천600만 점의 이미지 데이터 세트를 사용했다. 이 중 9천100만개를 학습용으로, 3천400만개를 검증용으로 분류했다.

그 후 연구팀은 플래닛의 능력을 10명의 ‘여행 경험이 풍부한 사람’과 비교하기 위해 웹 사이트 ‘Geoguessr’와 ‘Street View’의 사진집을 사용했다. 논문에 따르면 플래닛은 50라운드 중 28라운드 승리를 거뒀다.