메타가 차세대 비전 인공지능(AI) 모델 '샘(SAM) 3.1'을 공개하며 멀티모달 경쟁에서 기술 주도권 확보에 속도를 내고 있다. 영상 처리 속도와 효율성을 동시에 개선하며 그동안 높은 비용과 지연 문제로 제한됐던 비전 AI의 상용화 가능성을 한층 끌어올린 모습이다.

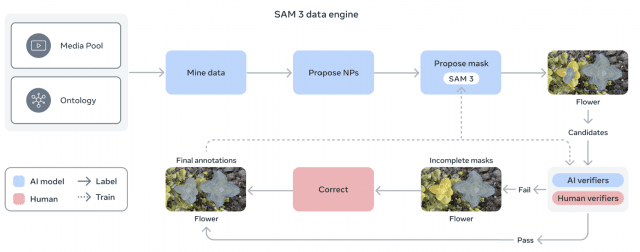

31일 업계에 따르면 메타 AI는 지난 27일 공식 블로그를 통해 이미지·영상 이해 모델 '샘 3(SAM 3, Segment Anything Model 3)'의 업그레이드 버전인 '샘 3.1'을 발표했다. 이번 모델은 객체를 동시에 처리하는 '멀티플렉싱(object multiplexing)' 구조를 도입해 기존 대비 연산 효율을 크게 개선한 것이 특징이다.

기존 모델이 객체별로 개별 연산을 수행했던 것과 달리 샘 3.1은 최대 16개 객체를 한 번의 연산으로 처리할 수 있다. 이를 통해 중복 계산을 제거하고 메모리 사용을 최적화하면서 영상 처리 속도를 기존 대비 두 배 수준으로 끌어올렸다. 단일 H100 그래픽처리장치(GPU) 기준 초당 32프레임 처리 성능을 구현하며 복잡한 장면에서도 실시간 객체 추적이 가능해졌다.

연산 구조 개선은 비용 측면에서도 의미가 크다. 동일한 작업을 더 적은 자원으로 수행할 수 있어 GPU 인프라 부담을 낮출 수 있기 때문이다. 업계에선 이를 두고 비전 AI가 연구·실험 단계에서 실제 서비스 적용 단계로 넘어가는 전환점으로 보고 있다.

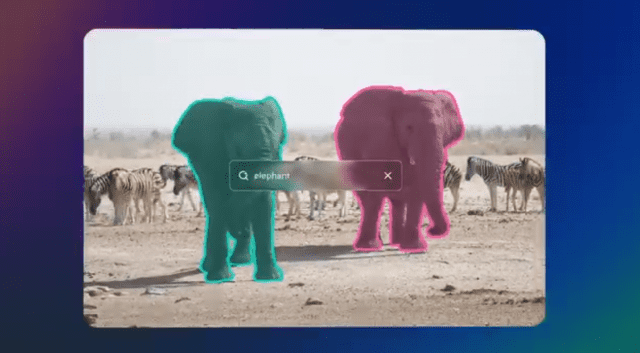

샘 3 계열은 텍스트, 이미지, 시각적 프롬프트를 결합해 객체 탐지와 세분화, 추적을 동시에 수행하는 통합형 모델이다. 특히 사전 정의된 범주에 제한되지 않는 '오픈 보캐뷸러리' 방식으로 다양한 개념을 인식할 수 있어 활용 범위가 넓다.

메타는 해당 기술을 자사 서비스에 빠르게 적용하고 있다. 인스타그램 영상 편집 기능에선 특정 인물이나 객체에 효과를 적용하는 기능이 도입될 예정이다. 메타 AI 플랫폼과 웹 서비스에서도 영상 생성 및 편집 기능이 확대되고 있다. 페이스북 마켓플레이스에서는 샘 3 기반 기술과 3D 복원 모델인 샘 3D를 활용해 가구를 가상 공간에 배치해보는 기능도 제공 중이다.

이번 발표는 멀티모달 AI 경쟁이 본격화되는 흐름과 맞물린다. 최근 AI 산업은 텍스트 중심에서 이미지와 영상, 음성까지 확장되며 복합 데이터를 동시에 이해하고 처리하는 능력이 핵심 경쟁력으로 부상하고 있다. 메타는 이미지 생성 중심 경쟁과 달리 시각 정보를 분석하고 추적하는 '이해 영역'에서 차별화 전략을 강화하는 모습이다.

다만 과제도 남아 있다. 의료·과학 등 전문 영역의 세밀한 개념 인식에는 추가 학습이 필요하며 복잡한 문장 기반 요청 처리 역시 제한적인 수준이다. 영상 처리 과정에서 객체 수 증가에 따라 연산 비용이 함께 늘어나는 구조 역시 향후 개선이 요구되는 부분으로 지적된다.

관련기사

- AI에 수백조 쏟는 메타, 직원 수백 명 자른다2026.03.26

- "AI 학습도 자체 칩으로” 메타, 반도체 기술 자립 속도 낸다2026.03.05

- 메타, 사기 광고로 매출 10% 수익 의혹…이용자 보호 실패 '논란'2025.11.07

- 소송 패소에 AI 투자 폭증…메타 흔드는 이중 악재2026.03.31

업계에선 이번 샘 3.1 공개를 비전 AI 상용화의 분기점으로 보고 있다. 성능과 비용이라는 핵심 제약 요인을 동시에 완화하면서 영상 분석·콘텐츠 제작·자율주행 등 다양한 산업 영역으로의 확산 가능성을 높였다는 평가다.

업계 관계자는 "샘 3.1은 비전 AI를 실험 단계에서 실제 서비스 단계로 끌어올린 모델"이라며 "향후 경쟁은 기술 자체보다 이를 얼마나 빠르게 산업과 플랫폼에 적용하느냐에 달려 있다"고 말했다.