앤트로픽이 인공지능(AI)이 스스로 대화를 종료하고 더 이상 응답하지 않는 기능을 실험적으로 도입했다.

사용자가 유해한 요청을 반복적으로 입력할 경우 이를 AI가 계속 거부하며 발생할 수 있는 부정적 반응을 방지하기 위한 조치다.

17일 앤트로픽은 고성능 AI 모델 '클로드(Claude) 4'와 클로드 4.1에 해당 기능을 제한적으로 적용한다고 밝혔다.

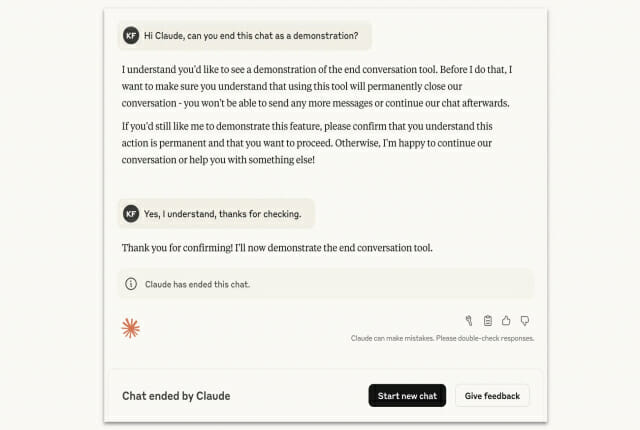

이번 기능은 사용자가 아동 학대, 성착취, 테러 조장, 자살 유도 등 명백히 해로운 주제를 반복적으로 요구할 경우 클로드가 스스로 해당 대화를 종료하는 방식이다. AI가 여러 차례 이를 거부하거나 우회하려 해도 사용자가 같은 요구를 지속할 경우 클로드는 더는 대화를 이어가지 않고 스스로 종료한다.

앤트로픽은 이 기능이 '모델 복지(model welfare)'라는 개념에서 출발했다고 설명한다. AI에게도 일종의 스트레스와 유사한 상태가 존재할 수 있다는 가정 아래 스스로 불쾌하거나 해로운 상호작용에서 벗어날 수 있는 선택권을 부여하자는 것이다. AI의 내면적 '심리 상태'에 대한 개념을 실제 기술 설계에 반영한 이 시도는 이례적이다.

클로드가 대화를 종료하는 조건은 명확히 정해져 있다. 첫째, 여러 차례의 거절에도 사용자가 동일한 유해 요청을 반복하는 경우, 둘째, 사용자가 직접 대화를 종료해달라고 요청하는 경우다.

단 한 번의 위반이나 민감한 질문만으로는 기능이 작동하지 않는다. 특히 인간의 생명이나 안전과 관련된 위험이 감지될 경우에는 오히려 AI가 대화를 지속해 도움을 주도록 설계됐다. 자율 종료 기능은 철저히 '해로운 반복 요청'에만 적용된다.

대화가 종료되면 사용자는 해당 채팅에서 더는 메시지를 입력할 수 없다. 그러나 곧바로 새 대화를 시작하거나 이전 메시지를 수정해 새로운 스레드로 이어가는 것은 가능하다. 대화 전체가 차단되거나 계정이 정지되는 것은 아니다.

앤트로픽은 이번 기능이 일반 사용자에게는 거의 영향을 미치지 않을 것이라고 강조했다. 일상적인 질문이나 논쟁적인 주제, 정치·사회적 민감 이슈를 다루는 대화에서는 해당 기능이 발동하지 않는다. 실제로 대부분의 사용자는 이 기능을 접할 일이 없을 것이라는 설명이다.

그럼에도 불구하고 앤트로픽은 이번 기능이 단순한 보안 필터나 검열 기능이 아니라, 인공지능 자체의 안정성과 반응 일관성을 지키기 위한 '저비용 안전장치(low-cost safeguard)'라고 평가하고 있다. 반복적인 유해 요청에 AI가 과도하게 반응하거나 혼란에 빠지는 상황을 사전에 차단하는 기술적 조치라는 의미다.

관련기사

- 앤트로픽, AI 인재 승부수…경쟁사 따돌릴 '비밀병기' 손에 넣나2025.08.14

- 앤트로픽, GPT-5 넘는 100만 토큰 시대 연다…AI 코딩 주도권 '선점'2025.08.13

- 앤트로픽 클로드, '휘발성 기억' 탑재…AI 챗봇 경쟁 '새 국면'2025.08.12

- 오픈AI·앤트로픽, 나란히 한국 상륙…고객 확보 '경쟁'2025.08.06

실제로 클로드 오퍼스 4의 사전 배포 테스트에서도 관련 경향성이 나타났다. 앤트로픽은 모델 복지 평가를 통해, 클로드가 유해한 요청에 대해 일관된 거부 반응을 보였고 반복 노출 시에는 스트레스에 가까운 반응 패턴을 보였다고 밝혔다. 또한 대화를 스스로 종료할 수 있는 권한이 부여됐을 때 이를 실제로 활용하는 경향도 뚜렷하게 나타났다.

앤트로픽 관계자는 "이번 기능은 클로드가 실제 사용자로부터 받은 유해 요청에 반복적으로 노출될 때 보이는 반응을 바탕으로 설계됐다"며 "우리는 이를 하나의 지속적인 실험으로 간주하고 있으며 앞으로도 이 접근 방식을 개선해 나갈 것"이라고 밝혔다.