인공지능 핵심 기술인 머신러닝을 모바일 기기에서 직접 구동시키려는 움직임이 가속화되고 있다. 구글이 클라우드의 강력한 컴퓨팅 파워 없이도, 스마트폰 내에서 잘 구동되는 새로운 이미지 인식(비전) 모델을 선보였다.

14일(현지시간) IT전문 외신 벤처비트 등은 구글이 스마트폰에서 구동되는 비전 모델인 ‘모바일넷’을 이날 오픈소스로 공개했다고 보도했다. (☞깃허브 링크)

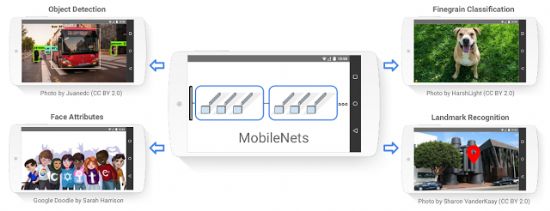

모바일넷은 사전에 훈련된 이미지 인식 모델로, 스마트폰의 컴퓨팅 자원만으로도 머신러닝 모델을 구동할 수 있는 것이 특징이다.

지금까지 모바일 앱에 사용된 머신러닝 모델들은 강력한 연산능력을 갖춘 클라우드에 상당 부분 의존했다. 사용자 모바일에서 데이터를 클라우드로 보내 연산을 마친 뒤, 결과를 모바일로 보내주는 방식이다.

이번에 구글이 공개한 모바일넷은 스마트폰에서 이미지 인식에 필요한 데이터 처리를 하기 때문에, 결과를 사용자에게 표출해주는 응답시간이 빠르고 사생활보호 문제에서도 보다 자유로울 수 있다.

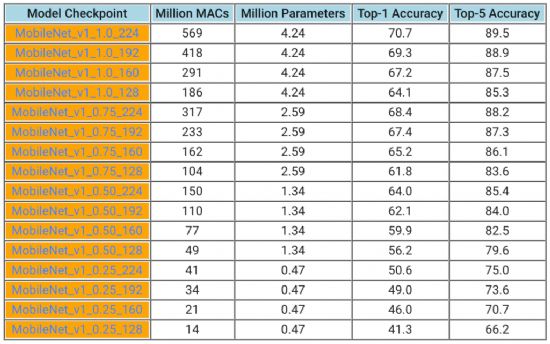

구글은 개발자들이 자신의 애플리케이션에 적합한 크기와 정확도를 고려해 여러 모델 세트 중 골라 사용할 수 있게 모바일넷을 구성했다. 예컨대 높은 정확도를 제공하는 모델을 선택하면, 연산 횟수가 많고 그만큼 모바일 컴퓨팅 자원에 부담을 준다.

구글, 페이스북, 애플 등 AI기술을 주도하고 있는 IT기업들은 최근 모바일 기기에서 머신러닝 모델 연산을 처리하는 기술에 관심을 보이고 있다.

관련기사

- MS, 머신러닝 민주화 앞당긴다2017.06.15

- 애플, 모바일 머신러닝 기술 공개..."구글보다 6배 빨라"2017.06.15

- 머신러닝 새 도전…“클라우드를 벗어나라"2017.06.15

- 구글, 모바일용 머신러닝 '텐서플로 라이트' 공개2017.06.15

구글은 지난달 텐서플로 라이트라는 모바일 머신러닝 프레임워크를 공개했다. 컴퓨팅 파워가 약한 스마트폰에서 구동되는 보다 효율적으로 머신러닝 모델을 만들 수 있는 프레임워크다. 개발자들은 텐서플로 라이트를 활용해 안드로이드, iOS, 라즈베리파이에서 작동되는 모바일 머신러닝 모델을 배포할 수 있다.

애플은 이달초 다양한 머신러닝 모델을 아이폰, 아이패드, 애플 워치에서 직접 구동시킬 수 있게 해주는 모바일 머신러닝 프레임워크 ‘코어ML’을 발표했다. 페이스북 역시 지난해 ‘카페투고’(Caffe2GO)라는 모바일용 머신러닝 프레임워크를 선보였다.