더 크고 강력한 인공지능(AI) 모델일수록 로봇을 더 잘 움직일 것이라는 통념이 데이터 앞에서 무너졌다. 가벼운 옛날 모델조차 평균 성공률 1%에 그쳤고, 같은 조건에서 더 강력한 신형 3D 모델은 0%로 더 무너졌다.

저장대(浙江大学)와 상하이과기대(ShanghaiTech University) 공동 연구팀이 2026년 4월 발표한 논문 'R3D: Revisiting 3D Policy Learning'은 그 원인이 모델의 한계가 아니라, 모두가 무심코 사용해온 두 가지 기술적 관행에 있었다고 지적한다. 이 발견은 자율 로봇과 산업용 매니퓰레이터(manipulator, 물건을 집고 옮기는 로봇 팔) 개발 속도에 직결된다.

강력한 3D 모델이 1% 성공률에 머문 스케일링 역설

3D 정책 학습(3D Policy Learning)이란 로봇이 카메라로 본 장면을 평면 이미지가 아닌 입체 점구름(point cloud, 공간상의 점 좌표 집합)으로 받아들여 행동을 결정하는 방식이다. 평면 이미지보다 거리감과 깊이를 정확히 파악할 수 있어 차세대 로봇 학습 방식으로 주목받아 왔다.

그러나 R3D 연구팀은 기존 연구에서 반복적으로 관찰된 기현상에 주목했다. 가벼운 옛날 신경망인 포인트넷(PointNet)으로 만든 정책이 더 크고 정교한 트랜스포머(Transformer) 기반 모델보다 일관되게 더 좋은 성능을 냈다는 점이다. 연구팀이 시험한 결과, 강력한 유니3D(Uni3D) 인코더를 그대로 적용한 3D 디퓨전 폴리시(DP3)는 다섯 개 양손 조작 과제 평균 성공률이 0%에 그쳤다. 같은 조건의 가벼운 포인트넷 버전도 1%에 머물렀고, 정규화 방식을 바꾼 뒤에야 포인트넷은 59.6%, 유니3D는 64.7%까지 올랐다. AI 업계의 상식인 "모델이 클수록 성능이 좋다"는 명제가 정반대 결과를 만들어낸 것이다.

배치 정규화 한 줄과 누락된 데이터 증강이라는 두 범인

원인은 모델 구조가 아니라 두 가지 사소한 구현 관행에 있었다. 첫째 범인은 배치 정규화(Batch Normalization, BN)였다. 배치 정규화란 신경망 학습 과정에서 데이터를 일정한 범위로 맞춰주는 표준 기법으로, 이미지 분야에서는 안정적으로 작동한다. 그러나 로봇 학습은 한 번에 학습시키는 데이터 묶음이 작고 변동이 심해 배치 정규화가 오히려 학습을 무너뜨린다. 연구팀이 배치 정규화를 레이어 정규화(Layer Normalization, LN, 한 데이터 안에서 정규화하는 방식)로 바꾸자, 0%에 머물던 강력한 모델의 성공률이 64.7%로 단번에 뛰었다.

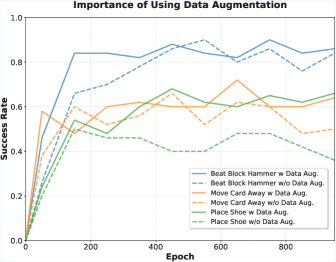

둘째 범인은 3D 데이터 증강(Data Augmentation)의 부재였다. 데이터 증강이란 한 장의 데이터를 살짝 변형해 여러 장처럼 만들어 모델에게 다양한 상황을 학습시키는 기법이다. 평면 이미지 학습에서는 이미 표준이지만, 3D 학습에서는 거의 적용되지 않고 있었다. R3D 연구팀은 점구름 색상 흔들기, 좌표에 미세 잡음 추가, 점 일부 삭제 같은 세 가지 증강 기법을 도입했다. 그 결과 학습 곡선이 안정화되고 시간이 지날수록 성능이 떨어지던 과적합(overfitting) 현상이 사라졌다.

그림1. 증강 없이는 훈련이 진행될수록 성공률이 떨어진다

공간 해상도를 압축하지 않은 디퓨전 트랜스포머의 78% 성능

R3D 연구팀은 두 범인 제거에 더해, 3D 정보를 끝까지 압축하지 않는 새로운 구조를 설계했다. 기존 DP3는 점구름 전체를 하나의 짧은 요약 벡터로 압축한 뒤 이를 행동 결정에 사용했다. 한 장면의 모든 디테일이 한 줄짜리 요약문으로 줄어든 셈이다.

R3D는 점구름을 여러 개의 패치(patch, 작은 조각)로 나누고, 각 패치의 위치와 모양 정보를 그대로 디퓨전 트랜스포머(Diffusion Transformer)라는 행동 생성 모듈에 넘긴다. 디퓨전 트랜스포머는 노이즈에서 출발해 점차 깨끗한 행동을 만들어내는 생성형 AI 구조로, 이미지 생성 모델과 같은 원리다. 행동을 만드는 과정에서 모델이 손잡이의 정확한 위치, 그릇의 가장자리 같은 세부 영역에 직접 주의를 기울일 수 있게 된 것이다.

그 결과 동일한 인코더라도 이 구조를 적용했을 때 평균 성공률이 62.5%에서 77.5%로 상승했다. 여기에 로봇 관절각과 함께 손끝 위치까지 동시에 예측하는 보조 학습을 추가하자 79.75%까지 올라갔다.

디스코 조명 아래에서도 58.7%를 지킨 실제 로봇 검증

연구팀은 시뮬레이션을 넘어 실제 로봇 팔(xArm6)과 두 대의 깊이 카메라(Intel RealSense D435)로 실험을 진행했다. 케틀(주전자)을 가스레인지에 올리기, 서랍 열기, 수건 접기 세 가지 과제에서 R3D의 평균 성공률은 68.7%를 기록했다. 비교 대상이었던 최신 모델 메니플로(ManiFlow)는 47.3%, 파이제로(Pi0)는 52.0%에 머물렀다.

특히 인상적인 결과는 디스코 조명을 켜고 색상이 시시각각 변하는 환경에서의 시험이었다. 빛이 변하면 카메라가 잡는 색상도 달라져 모든 모델의 성능이 떨어졌지만, R3D는 58.7%를 유지한 반면 메니플로는 40.7%, DP3는 30.7%로 무너졌다. 약 18%포인트의 차이는 단순 수치로 보일 수 있지만, 실제 가정이나 물류창고처럼 조명이 일정하지 않은 현장에서는 로봇이 멈추느냐 작업을 끝내느냐를 가르는 격차가 된다. 카메라를 한 대만 쓸 때와 두 대 쓸 때의 비교에서도 R3D는 두 설정 모두에서 가장 높은 성공률을 보였다.

에디터 해석, 모델 키우기 경쟁이 끝나가는 신호일 가능성

R3D의 결과는 AI 업계가 경쟁적으로 모델 크기를 키워온 흐름과는 결이 다른 신호로 읽힐 가능성이 있다. 더 큰 모델이 더 나은 성능을 보장하지 않으며, 학습 안정성과 데이터 다양성 같은 기초 요소가 오히려 결정적이라는 점이 드러났기 때문이다. 다만 이 발견이 다른 AI 분야에까지 일반화될지는 두고 볼 필요가 있다. 논문은 양손 조작과 정밀 삽입 같은 특정 로봇 과제에 한정해 검증했으며, 자연어 처리나 이미지 생성처럼 데이터 규모가 훨씬 큰 영역에서는 다른 결론이 나올 수도 있다.

또한 이번 연구가 제시한 R3D 구조는 사전학습 데이터셋과 모델 크기, 카메라 구성에 따라 최적값이 달라진다는 점도 함께 보고됐다. 1024개 점에서는 ViT-tiny가, 8192개 점에서는 ViT-small이 가장 좋은 성능을 보인 결과는 모든 환경에 들어맞는 단일 정답이 없다는 의미로도 읽힌다. 로봇 정책 학습이 새로운 기반을 갖게 된 것은 분명하지만, 어떤 환경에 어떤 설정이 맞는지를 찾는 후속 연구가 이어질 것으로 보인다.

FAQ(이 FAQ는 본지가 리포트를 참고해 자체 작성한 내용입니다.)

Q1. 3D 정책 학습이 기존 2D 학습보다 좋은 점은 무엇인가요?

A1. 3D 정책 학습은 로봇이 평면 이미지가 아닌 입체 정보로 세상을 인식합니다. 덕분에 카메라 각도가 바뀌어도 흔들리지 않고, 로봇 종류가 달라져도 학습한 기술을 그대로 옮겨 쓸 수 있습니다. 거리감과 깊이를 정확히 파악할 수 있어 정밀한 조립이나 잡기 작업에 유리합니다.

Q2. R3D가 발견한 두 가지 핵심 개선점은 무엇인가요?

A2. 첫째는 배치 정규화 대신 레이어 정규화를 사용하는 것입니다. 로봇 학습은 데이터 변동이 커서 배치 정규화가 학습을 망치기 때문입니다. 둘째는 3D 데이터 증강을 도입하는 것입니다. 점구름의 색상과 위치를 살짝 흔들어 다양한 상황을 학습시키면 모델이 새로운 환경에서도 안정적으로 작동합니다.

Q3. 이 연구가 일반 사용자에게 어떤 영향을 미칠 수 있나요?

관련기사

- AI가 쓴 법학 논문, 학계는 어떻게 다룰까…4월의 새로운 질문2026.04.27

- 생성형 AI 최대 난제 조명 제어, 예일대·어도비가 '조명 토큰'으로 풀었다2026.04.24

- AI에게 접시 가져다달라 했더니 냉장고부터 연 이유2026.04.23

- 메타, 美 직원 PC에 마우스·키보드 추적 도구 설치… "AI 에이전트 학습용"2026.04.23

A3. 가정용 로봇이나 물류 창고 로봇처럼 조명이 일정하지 않은 환경에서 로봇이 더 안정적으로 작동할 수 있게 됩니다. 또한 같은 학습 데이터로도 더 정확하게 작업하는 로봇을 만들 수 있어, 로봇 도입 비용을 낮추고 활용 범위를 넓히는 데 기여할 수 있습니다.

■ 이 기사는 AI 전문 매체 ‘AI 매터스’와 제휴를 통해 제공됩니다. 기사는 클로드 3.5 소네트와 챗GPT를 활용해 작성되었습니다. (☞ 기사 원문 바로가기)