기업 77%가 AI 시대 사이버보안 "매우 우려"

인공지능(AI)이 기업에 도입되는 속도가 빨라지는 가운데, 사이버 범죄자들의 공격도 갈수록 정교해지고 있다. 세계경제포럼(World Economic Forum)은 사이버보안을 세계 10대 위협 중 하나로 지정했으며, 딜로이트(Deloitte)의 2023 미래 사이버 설문조사에 따르면 응답자 10명 중 9명이 자신의 조직에서 최소 한 번 이상의 보안 침해를 경험했다고 보고했다. (☞ 보고서 바로가기)

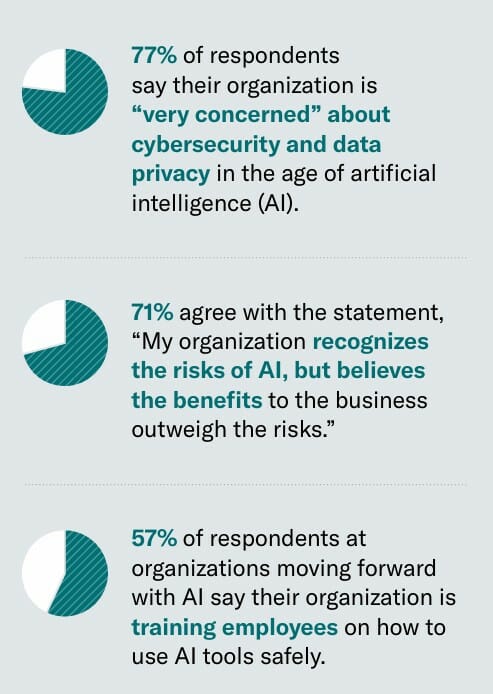

하버드 비즈니스 리뷰 애널리틱 서비스(Harvard Business Review Analytic Services)가 2024년 9월 IT 의사결정에 관여하는 227명을 대상으로 실시한 설문조사에 따르면, 응답자의 77%가 AI 시대의 사이버보안과 데이터 프라이버시에 대해 "매우 우려된다"고 답했다. 18%는 "다소 우려된다"고 응답했다.

그러나 이러한 광범위한 우려에도 불구하고, 경영진들은 AI의 흥분과 투자의 물결에 휩싸여 있다. AI 도구는 모든 규모와 섹터의 조직에서 빠르게 확산되고 있으며, 최고정보책임자(CIO), 최고정보보안책임자(CISO), 최고기술책임자(CTO)와 같은 기업 데이터 보안 담당 임원들은 이제 이러한 도구를 관리되고 안전하며 생산적인 방식으로 활용할 방법을 찾아야 한다.

AI 도입 기업 71%가 '이익이 위험보다 크다' 판단

샌프란시스코의 글로벌 데이터 및 AI 기업인 데이터브릭스(Databricks)의 보안 및 현장 CISO 부사장 오마르 카와자(Omar Khawaja)는 "현재 많은 조직이 AI에 대한 깊은 욕구와 이를 소비할 인내력 부족을 보이고 있으며, 이는 위험 관점에서 좋은 조합이 아니다"라고 말했다.

카와자에 따르면 이러한 상황은 비즈니스 가치와 위험에 대한 실용적 평가와 위험을 관리하기 위한 냉정한 접근 방식이 필요하다. "우리는 사람들이 극단적인 두려움이나 극단적인 흥분의 스펙트럼 가장자리에서 벗어나 AI와 관련된 위험이 있지만 놀라운 긍정적 결과도 있다는 것을 받아들이는 자리로 이동해야 한다"고 그는 주장한다. "그리고 우리는 그러한 위험을 완화하기 위한 통제 장치를 식별하여 방정식의 균형을 긍정적인 방향으로 돌릴 필요가 있다."

현재 정보, 보안 및 기술 고위 관리자들이 사용할 수 있는 많은 도구와 접근 방식이 있다. 프라이버시와 고객 신원 보호, 엔드포인트 보안, 데이터 보호, 제로 트러스트(zero trust) 보안 구현 등은 이제 AI 준비 조직을 만드는 기본 요소가 되고 있다. 또한 조직 문화는 직원들이 AI 도구를 안전하게 사용하는 방법을 이해하도록 하는 데 중요한 역할을 한다.

피싱부터 딥페이크까지: 사이버 범죄자들의 AI 무기화 사례 증가

AI 모델은 기본적으로 데이터를 학습한 후 출력을 생성하는 학습 시스템이다. 이론적으로 이 과정은 특정 사이버보안 및 데이터 프라이버시 관련 위험을 증가시킨다. 예를 들어, 사이버 범죄자들이 민감한 데이터를 얻거나 데이터 코딩과 출력을 방해하기 위해 AI 시스템에 침입할 가능성이 있다.

캘리포니아 포스터 시티에 본사를 둔 글로벌 사이버보안 회사 엑자빔(Exabeam Inc.)은 AI 맥락에서의 사이버보안을 "AI 시스템을 사이버 위협으로부터 보호하고 안전한 작동을 보장하기 위해 설계된 조치와 기술"로 설명한다. "여기에는 AI 시스템이 훈련되는 데이터를 보호하고, AI 알고리즘의 무결성을 보호하며, AI 애플리케이션이 악의적인 목적으로 사용되지 않도록 보장하는 것이 포함된다."

많은 전문가들은 사이버 범죄자들이 AI 시스템을 해킹하는 위협이 지평선 상에 있을 수 있다고 믿지만, 기업에게 더 가까운 우려는 범죄자들이 AI를 사용하여 더 설득력 있고 정교한 공격을 만드는 것이다.

직원 인식 부족이 최대 보안 위협

대부분의 공개 AI 도구는 무료로 사용할 수 있고 사용자 입력과 프롬프트에 기반한 콘텐츠를 생성할 수 있어 우려의 대상이다. CAMS의 피어슨은 "직원들이 회사의 지적 재산(IP)을 도구에 입력했다가 그 IP가 다른 사용자에게 제공되는 답변에 사용된 몇 가지 고프로파일 사례가 있었다"고 말한다. "회사는 공개하고 싶지 않은 것을 노출했고, 이제 '누가 답변을 소유하는가?'라는 질문이 제기된다."

이러한 위험을 고려할 때, 많은 조직이 직원들이 이러한 도구를 사용하는 것에 대해 우려하는 것은 놀라운 일이 아니다. 응답자의 44%는 직원들이 공개 AI 모델이나 도구를 사용하는 것에 대해 "매우 우려된다"고 답했으며, 또 다른 44%는 "다소 우려된다"고 답했다.

AI를 도입하고 있는 기업들에게 AI 사용에서 직면하는 가장 큰 보안 또는 데이터 프라이버시 문제는 직원들의 AI 사용 위험에 대한 인식 부족이며, 이는 응답자의 51%가 선택했다. 또한 42%는 직원들의 공개 AI 도구 사용에 대한 감독 부족을, 36%는 데이터 거버넌스 부족을 주요 문제로 지적했다.

직원 교육(57%)과 데이터 거버넌스(57%) 강화가 최우선

슬로바키아 브라티슬라바에 본사를 둔 글로벌 사이버보안 회사 ESET의 최고 보안 에반젤리스트인 토니 앤스콤브(Tony Anscombe)는 공개 AI 도구 사용을 금지하는 것이 해결책이 아니라는 의견을 공유한다. "접근을 금지하는 것보다 통제된 접근을 갖는 것이 낫고, 직원들에게 도구를 어떤 목적으로 사용해야 하고 어떤 목적으로 사용하지 말아야 하는지 가르칠 필요가 있다"고 그는 말한다.

그러나 많은 조직이 공개 AI 도구 사용을 금지하는 것과 같은 강력한 전술을 사용하고 있다. 공개 AI 도구의 직원 사용을 관리하기 위해 조직이 취하는 가장 일반적인 조치는 업무용으로 이러한 도구를 사용하지 말 것을 조언하거나 주의를 주는 것(47%)이지만, 거의 4분의 1(24%)은 이러한 도구에 대한 접근을 완전히 차단했다.

FAQ

Q: AI가 사이버보안에 미치는 가장 큰 위협은 무엇인가?

A: AI가 사이버보안에 미치는 가장 큰 위협은 두 가지로 나눌 수 있다. 첫째, 사이버 범죄자들이 AI를 활용해 피싱과 같은 더 정교하고 설득력 있는 공격을 만드는 것이다. 둘째, 직원들이 회사의 민감한 정보를 무료 AI 도구에 무심코 입력해 데이터 유출이 발생하는 것이다. 설문조사에 따르면 응답자의 71%가 사이버 범죄자가 AI를 사용해 더 정교한 공격을 실행하는 것에 "매우 우려된다"고 응답했다.

Q: 기업이 AI 도입과 보안을 균형 있게 관리하는 방법은?

관련기사

- [Q&AI] 3월 근로장려금 신청 어떻게…17일 마감, 지급은?2025.03.04

- 콘텐츠 폭발 시대...생성형 AI로 주도권 잡는 법2025.03.02

- [Q&AI] 120만 유튜버 유우키 채널 삭제…성추행 무고 사건 총 정리2025.02.28

- 삼성전자, 노사 사후조정 결렬...총파업 '눈앞'2026.05.13

A: 기업이 AI 도입과 보안을 균형 있게 관리하는 방법으로는 직원 교육 강화(57%), 데이터 거버넌스 개선(57%), 사이버보안 인식 캠페인 실시(46%) 등이 있다. 또한 공개 AI 도구 사용에 대한 감독 강화, AI를 활용한 위협 탐지, 엔드포인트 보안 관리 강화 등도 효과적인 전략이다. 중요한 것은 AI 위험과 이익에 대한 실용적인 평가를 바탕으로 균형 잡힌 접근 방식을 취하는 것이다.

■ 이 기사는 AI 전문 매체 ‘AI 매터스’와 제휴를 통해 제공됩니다. 기사는 클로드 3.5 소네트와 챗GPT를 활용해 작성되었습니다. (☞ 기사 원문 바로가기)