"현재 AI 관련 처리 시장이 주로 GPU에 주목하고 있지만 AI는 여전히 초기 단계이며 CPU 역시 GPU 못지 않게 다양한 작업을 처리한다. 엔터프라이즈 데이터베이스, 대형 ERP(전사적 자원관리) 처리에는 여전히 CPU 코어의 성능 향상이 중요하다."

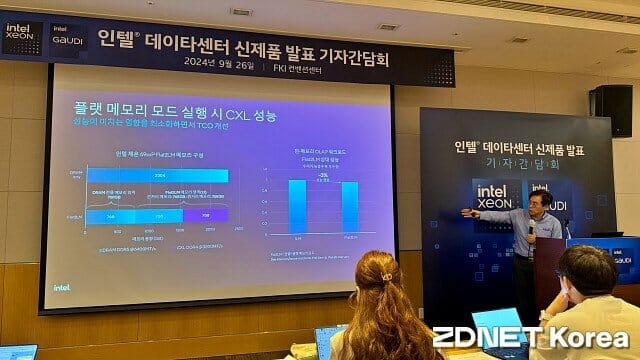

26일 오전 서울 여의도에서 진행된 제온6 프로세서·가우디3 AI 가속기 브리핑에서 나승주 인텔코리아 상무가 제온6 프로세서 강점에 대해 이렇게 설명했다.

인텔이 25일 전세계 출시한 제온6 6900P 프로세서는 고성능 P(퍼포먼스) 코어를 최대 3개 타일에 분할해 집적하는 방식으로 한 소켓 당 코어 수를 최대 128개까지 늘렸다. 2018년 이후 코어 수를 앞세워 서버·데이터센터 시장을 파고든 AMD 에픽(EPYC) 프로세서와 동등한 수준까지 올라왔다.

이날 나승주 인텔코리아 상무는 "제온6 6900P 프로세서는 코어당 고성능 제품을 원하는 고객을 위한 제품이며 조만간 주요 OEM에서 오늘 출시한 인텔 제품을 탑재한 서버를 국내 출시 예정"이라고 밝혔다.

■ 인텔 3 기반 코어 다이 3개로 최대 128코어 구현

제온6 6900P 프로세서는 프로세서 코어를 포함한 컴퓨트 다이(Die)는 EUV(극자외선)를 활용한 인텔 3(Intel 3) 공정에서, 메모리와 각종 가속기를 포함한 I/O 다이는 인텔 7(Intel 7) 공정에서 생산했다.

나승주 상무는 "성능과 집적도가 중요한 컴퓨트 다이는 최신 공정을, 제조 원가와 작동 주파수 등에서 요구사항이 큰 I/O 다이는 한 세대 전 공정인 인텔 7을 활용한 것"이라고 설명했다.

최대 128개 코어를 탑재할 수 있는 UCC는 컴퓨트 다이 3개, 최대 86개 코어를 탑재할 수 있는 XCC 모델은 컴퓨트 다이 2개, 최대 48개 코어를 탑재하는 HCC는 컴퓨트 다이 1개로 구성된다.

PCI 익스프레스 5.0 레인(lane, 데이터 전송 통로)와 메모리 대역폭을 축소한 LCC 모델은 최대 16개 코어를 탑재한다. 각 타일은 반도체 평면 연결 기술인 인텔 EMIB로 연결된다. 이 중 128개 코어 탑재 UCC 모델이 우선 공급되며 나머지 모델은 내년 초부터 시장에 공급된다.

■ MRDIMM·CXL 2.0 타입3로 최대 3TB 메모리 운용 가능

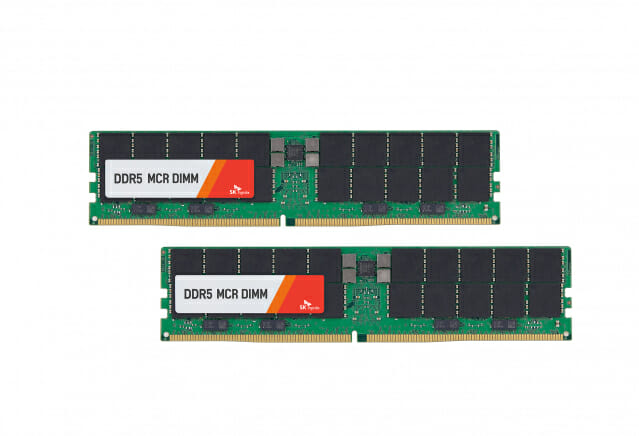

인메모리 데이터베이스 등 대용량 데이터 처리시 가능한 한 많은 데이터를 메모리에 올려야 처리 효율을 높일 수 있다. 제온6 6900P는 DDR5-6400MHz와 MRDIMM 8400MHz 메모리와 CXL 2.0 타입3를 활용해 최대 3TB 메모리를 운용할 수 있다.

MRDIMM(멀티랭크 DIMM)은 디램 메모리 집적도를 두 배로 높여 최대 접근 가능한 메모리 용량을 늘려서 성능을 30-50% 가량 높일 수 있다. 나승주 상무는 "현재 삼성전자, SK하이닉스, 마이크론 등 주요 메모리 제조사와 협업하고 있다"고 설명했다.

CXL(컴퓨트 익스프레스 링크) 기술은 PCI 익스프레스 기반으로 디램을 유연하게 확장할 수 있다. 제온6는 CXL로 연결된 메모리 모듈까지 메모리와 직접 연결된 상태로 활용할 수 있다.

나승주 상무는 "데이터센터 업데이트 후 남은 DDR4 메모리를 모아 CXL 2.0 방식으로 연결하면 메모리 탑재 비용은 줄이면서 더 큰 메모리 용량을 쓸 수 있고 성능 저하는 프로세서와 직접 연결된 메모리 대비 3%에 불과해 효율적"이라고 밝혔다.

■ AI 처리 확대 위한 명령어 추가... BF16/FP16 모두 지원

AI 처리의 대부분은 행렬(matrix) 형태로 구성된 데이터를 처리하는 과정으로 진행된다. 제온6 P시리즈는 이를 처리하는 내장 가속기인 AMX(고급 벡터 확장)에 FP16(부동소수점 16비트) 처리 기능을 추가했다.

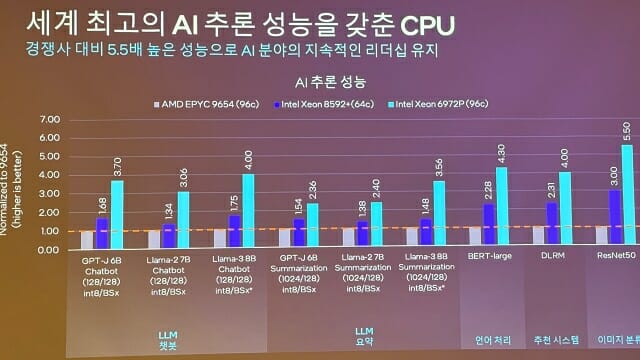

나승주 상무는 "제온6 6972P(96코어)는 메타 라마2(Llama-2) 70억 매개변수 챗봇, GPT-J 60억 매개변수 요약 등 AI 추론 실행시 전 세대 대비 2배 이상, AMD 에픽 9654(96코어) 대비 최대 5배 이상 빠른 성능을 낸다"고 밝혔다.

이어 "GPU를 이용한 AI 가속시에도 전통적인 서버용 프로세서는 데이터 전처리, 전송은 물론 CPU에서 더 효율적으로 처리 가능한 AI 워크로드를 실행하고 있으며 엔비디아 HGX/MGX와 조합해 더 나은 성능을 낼 수 있다"고 밝혔다.

■ "가우디3, 개방형 생태계에 최적화"

인텔은 가우디3 AI 가속기도 10월부터 국내외 시장에 공급 예정이다. 서버용 OCP 가속화 모듈인 HL-325L, HL-325L을 8개 탑재한 UBB 표준 모듈인 HLB-325, 워크스테이션에 장착 가능한 확장 카드인 HL-338 등 3개 형태로 시장에 공급된다.

관련기사

- 인텔, E코어 기반 서버용 칩 '제온6 6700E' 출시2024.06.04

- 박경 SK하이닉스 부사장 "AI 시대, 메모리 단품이 아닌 솔루션으로 변화 필요"2024.08.27

- 삼성전자, 하반기도 메모리가 이끈다..."AI 서버향 적극 대응"2024.07.31

- 삼성전자, P4 최종 라인까지 설비 발주…HBM 양산 속도 '고삐'2026.04.06

나승주 상무는 "가우디3 성능 비교 결과 80억 매개변수 내장 메타 라마3 처리에서 엔비디아 H100 대비 9% 더 나은 성능을 내지만 가격은 2/3 수준이다. 비용 대비 효율성은 약 2배이며 향후 소프트웨어 최적화로 더 개선될 것"이라고 밝혔다.

그는 또 "가우디3는 업계 표준인 이더넷 기술을 활용하는 개방형 생태계에 최적화된 제품이며 가격 효율성 측면에서 강점을 지녔다. 엔비디아 등 특정 제조사에 종속되는 것을 원하지 않는 고객사에게 충분한 장점을 제공할 것"이라고 덧붙였다.