[타이베이(대만)=권봉석 기자] AI PC의 핵심은 클라우드에 의존했던 AI 기능을 PC로 가져오는 것이다. 미리 학습된 AI 모델을 내려받아 CPU와 GPU, NPU(신경망처리장치)를 모두 활용해 가동하므로 LTE/5G나 와이파이가 없는 곳에서도 작동한다.

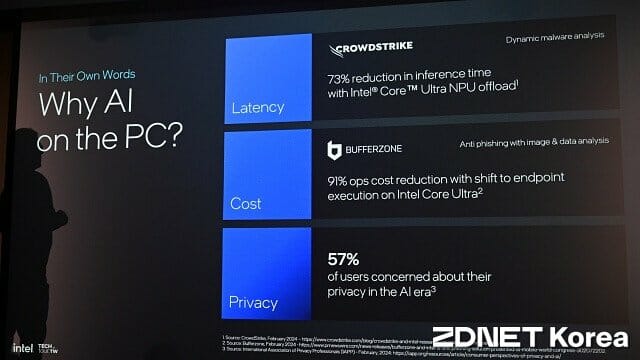

톰 피터슨(Tom Peterson) 인텔 그래픽 및 소프트웨어 아키텍처 부문 펠로우는 지난 주 진행된 '테크투어 타이완' 행사에서 "AI PC는 금융 정보나 건강 정보 등 민감한 정보를 관리하는 한편 이용자 특성을 학습해 맞춤형 비서 서비스를 제공할 수 있다"고 밝혔다.

이어 "금융 정보나 건강 정보 모두 외부에 공개하기 어려운 정보지만 AI PC는 이를 클라우드에 올리는 대신 기기 내에서 자체적으로 처리해 사생활 침해나 유출을 막는다"고 덧붙였다.

■ "AI PC 구현에 CPU·GPU·NPU 모두 중요"

현재 인텔을 포함해 주요 프로세서 제조사가 AI 처리 성능 기준으로 NPU TOPS(1초당 1조 번 연산)를 내세운다. 이는 모든 AI 처리가 NPU만 활용한다는 인식을 줄 수 있지만 실제는 이와 다르다.

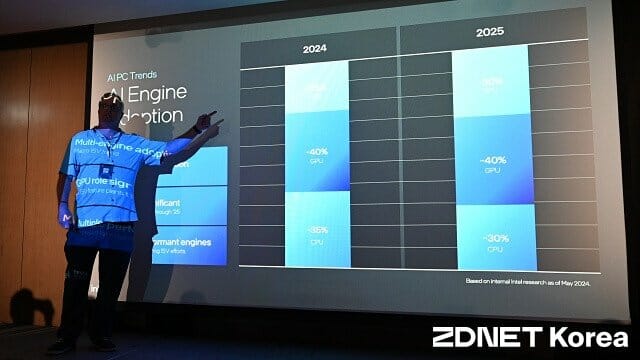

톰 피터슨 펠로우는 지난 5월 인텔 자체 조사 결과를 토대로 "올해 AI 엔진을 구동하는 장치 비중은 NPU가 25%, GPU가 40%, CPU가 35%지만 내년에는 NPU 비율이 30%대로 다소 상승, CPU 비율은 30%로 다소 변화가 있을 것"이라고 전망했다.

그는 "AI 응용프로그램의 작동 방식에 따라 차이가 있다. GPU는 생성과 인식에, NPU는 항시 가동돼야 하는 악성코드 감지 등에 유용하다. CPU의 TOPS는 낮지만 빠른 시간 안에 결과를 얻어야 할 때 유용하다"고 설명했다.

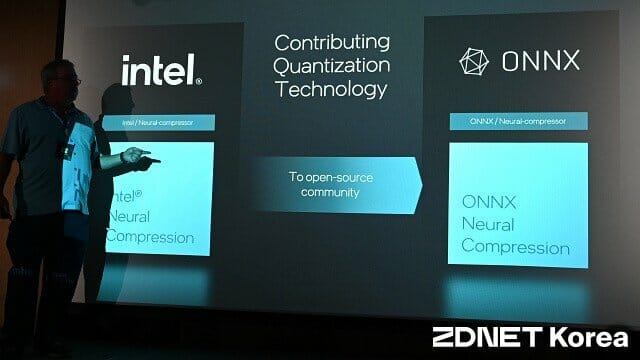

■ "AI 처리 부하 줄이는 양자화 기술, 오픈소스로 개방"

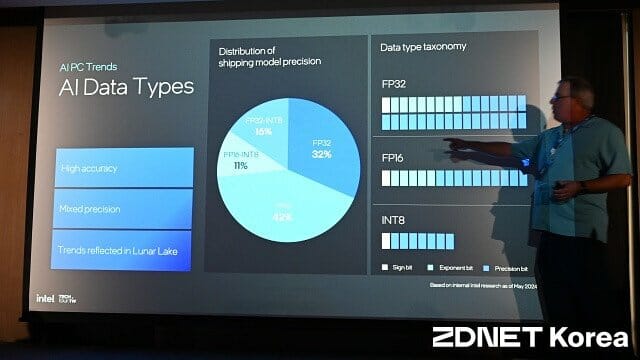

AI 모델의 정밀도가 높아질 수록 처리 시간과 용량, CPU/GPU/NPU에 가해지는 부하도 급증한다. 현재 AI 모델의 주류를 이루는 것은 FP32(32비트 부동소수점), FP16이지만 용량과 처리 속도 면에서 이를 PC로 처리하는 데는 무리가 있다.

정밀도를 FP16(32비트 부동소수점), INT8(8비트 정수) 등 PC에서 처리할 수 있는 수준으로 조절해야 한다. 이를 해결하기 위한 방법이 양자화이며 처리 속도 향상, AI 모델 용량 축소 등이 가능하다.

톰 피터슨 펠로우는 "양자화를 쉽게 처리할 수 있는 기술인 '인텔 신경망 압축'을 오픈소스 AI 생태계인 ONNX에 오픈소스 기술로 제공할 것"이라고 설명했다.

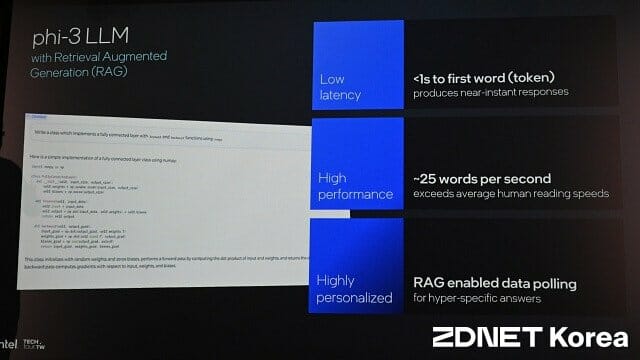

■ 인텔, 파이3 코어 울트라에 최적화...초당 25 단어 생성

인텔은 지난 4월 공개된 마이크로소프트 LLM(거대언어모델)인 파이3를 코어 울트라 시리즈 프로세서에 최적화했다.

코어 울트라 시리즈1(메테오레이크)에서 첫 단어가 나오는 데는 1초 미만, 초당 25단어를 생성해 이미 사람 눈으로 따라갈 수 없는 수준까지 향상됐다. 루나레이크의 AI 처리 성능은 여기서 한 단게 더 나아갔을 것으로 추정된다.

톰 피터슨 펠로우는 "AI 처리 속도를 높이는 것은 매우 중요한 일이다. 앞으로는 AI 응용프로그램이 사람 대신 다른 프로그램, 다른 서비스와 직접 상호작용하며 학습하게 될 것"이라고 설명했다.

■ "생태계 확대 위해 루나레이크 개발자 키트 곧 공급"

인텔이 AI PC 구현을 위해 이용하는 기술은 오픈비노(OpenVINO)다. PC의 CPU와 GPU, NPU를 모두 활용해 AI 처리 연산을 가속한다. 윈도 다이렉트ML, ONNX 런타임, 윈도 AI 등 다양한 소프트웨어를 지원한다.

관련기사

- Arm, 3나노 공정 검증 마친 클라이언트용 'Arm CSS' 발표2024.05.30

- 인텔 "노트북용 CPU '루나레이크' 3분기 출시"2024.05.21

- 인텔 "루나레이크 AI 성능, 전작 대비 3배 높일 것"2024.04.10

- 인텔, 올 하반기 출시할 노트북용 '루나레이크' 시제품 공개2024.01.09

인텔은 오픈비노를 활용한 개발자 생태계 확대를 위해 루나레이크 프로세서 기반 AI PC 개발 키트도 사전 공급할 예정이다. 가로·세로 165mm×150mm, 높이 27mm의 슬림한 케이스에 루나레이크 프로세서와 LPDDR5 32GB 메모리를 장착했다.

톰 피터슨 펠로우는 "루나레이크는 5 TOPS CPU, 67 TOPS GPU, 48 TOPS NPU를 결합해 최대 120 TOPS를 발휘할 수 있으며 게임과 AI 비서, 생성 AI를 이용한 콘텐츠 제작에 최적화됐다"고 강조했다.