인텔이 네이버와 AI 가속기 '가우디2'(Gaudi 2)를 이용한 LLM(거대언어모델)과 소프트웨어 생태계 확대에 나선다.

네이버클라우드는 인텔 개발자 클라우드 상에 구축된 가우디2 인스턴스를 활용해 LLM 구축 가능성을 평가하는 한편 국내 대학교·스타트업과 협업해 가우디2 기반 오픈소스 모델 등을 공동 개발할 예정이다.

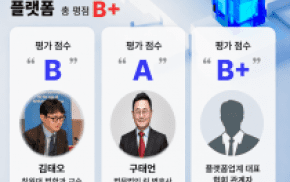

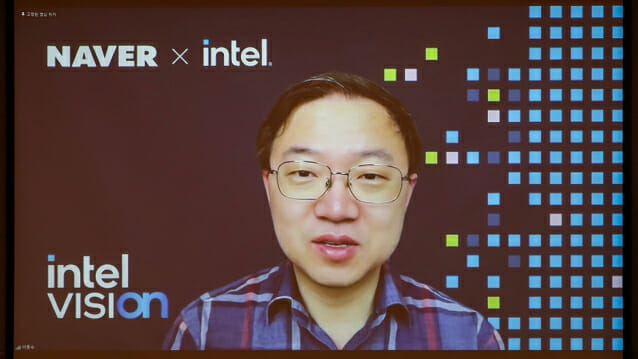

11일 오전 서울 여의도 한경협회관에서 인텔코리아 주최로 진행된 질의응답에서 이동수 네이버클라우드 하이퍼스케일 AI담당 이사(박사)는 "네이버와 인텔 협력 결과물이 오픈소스로 제공되면 학계와 스타트업의 AI 소프트웨어 개발의 문턱을 크게 낮출 수 있다. 국산 소프트웨어 대중화 면에서 큰 의미가 있다"고 강조했다.

■ 네이버 "가우디2 기반 고성능 LLM 모델 개발 목표"

인텔은 9일(미국 현지시간) 미국 애리조나 주 피닉스에서 진행된 '인텔 비전' 행사에서 네이버와 협업을 발표했다.

당일 기조연설에 등장한 하정우 네이버클라우드 AI 혁신센터장은 "생성 AI 생태계 확대를 위한 공동 연구소 설립, 가우디2 성능 평가, LLM(거대언어모델) 인스턴스 제공을 위해 인텔과 협업할 것"이라고 밝혔다.

하정우 혁신센터장은 "가우디2 가속기는 AI 전용 설계를 통해 와트당 성능과 총소유비용(TCO) 측면에서 뛰어난 성능을 낸다. 이번 인텔과 협력을 통해 고성능, 비용 효율 인프라 기반으로 강력한 LLM 기반 모델을 개발하는 것이 목표"라고 설명했다.

■ "가우디2, 하드웨어 특성·성능 면에서 좋은 평가"

이날 오전 이동수 네이버클라우드 하이퍼스케일 AI담당 이사(박사)는 "네이버는 현재 거의 모든 서비스에 AI 기술을 접목하고 있으며 좋은 AI 반도체 확보는 서비스 경쟁력 확보에 직결된다"고 설명했다.

이어 "많은 반도체를 평가하고 분석하는 과정에서 인텔 가우디2 가속기의 하드웨어 특징과 성능 면에서 좋은 결과를 얻었고 이것을 향후 네이버 서비스와 융합하려면 생태계와 소프트웨어 확보가 필요하다"고 밝혔다.

이날 네이버클라우드 관계자는 "일부 언론 관측처럼 이번 협업에 네이버 사옥이나 데이터센터 내에 물리적인 공간을 확보하는 것은 아니다. 평가는 가우디2가 적용된 인텔 개발자 클라우드를 활용할 것"이라고 밝혔다.

■ "가우디2 기반 최적화 코드로 개발 문턱 낮출 것"

이동수 이사는 "현재 LLM 기반 코드 최적화는 고수준 언어가 아닌 어셈블리어(기계어) 수준에서 이뤄지지만 이런 기술력을 갖춘 엔지니어는 극히 드물다"고 설명했다.

이어 "엔비디아 쿠다 역시 하드웨어가 바뀔 때마다 코드를 바꿔야 한다. 이런 난점때문에 엔비디아 역시 별도 개발 없이 기업들이 그대로 쓸 수 있는 바이너리(실행파일)를 제공하고 있다"고 설명했다.

권세중 네이버클라우드 리더는 "국내 대학과 스타트업은 GPU나 가속기 활용이 어려워 연구에 어려움을 겪는다. 국내 상위권 대학 내 연구실과 협업을 논의중이며 이들이 가우디2 기반 코드를 오픈소스로 공개하면 어려움을 덜 수 있을 것"이라고 밝혔다.

■ "삼성전자 마하1도 활용... 생태계 확장이 우선"

이동수 이사는 "가우디2 역시 성능 대비 전력 효율성이 뛰어나며 LLM이나 서비스 운영에 여전히 장점을 지니고 있다. 이번 인텔과 협업은 소프트웨어나 생태계 확장에 중점을 둔 것이며 소프트웨어나 드라이버 등이 안정된 가우디2로 진행할 것"이라고 설명했다.

관련기사

- 인텔이 찜한 네이버클라우드, '가우디' 기반 AI칩 생태계 조성 앞장2024.04.11

- 인텔 "가우디3 AI 가속기, 오는 3분기 출시"2024.04.10

- 인텔 "올 2분기 중 P·E코어 제온6 출하"2024.04.10

- 인텔 "루나레이크 AI 성능, 전작 대비 3배 높일 것"2024.04.10

반도체 업계에 따르면 네이버는 LLM 처리에 특화된 삼성전자 AI 반도체 '마하1'을 이르면 올 연말부터 공급받아 활용할 예정이다.

이동수 이사는 "인텔과 삼성전자 모두 중요한 협력사이며 함께 생태계 확장을 하는 것이 목표다. 마하1이나 가우디2는 모두 초기 단계이며 모델 학습·훈련이나 추론 등 용도를 정해둔 것은 아니다"라고 밝혔다.