몇 년전 꽤 인기 끌었던 예능 프로그램이 있었다. 출연자들이 다양한 상식을 자유롭게 풀어내는 프로그램이었다. 눈길을 끈 것은 프로그램 출연자들의 놀라운 지식이었다. 다양한 주제를 넘나들면서 깊이 있게 풀어내는 능력에 감탄을 금치 못했다.

그런데 담당 PD가 털어놓은 말이 흥미로웠다. 제작진이 가장 신경 썼던 것은 출연자들이 쏟아낸 잡학다식에서 틀린 부분을 가려내는 일이었다고 한다. 들을 땐 그럴 듯 했는데, 나중에 확인해보면 틀린 얘기인 경우가 생각보다 많았다는 얘기였다.

시청자들 사이에서 '잡학다식'한 것으로 유명했던 출연자의 말들 중에 특히 틀린 얘기가 많았다고 한다.

■ "오류-편견 많기 때문에 기사 작성을 모두 맡기는 건 금지"

챗GPT 열풍이 언론에 미칠 영향에 대해 생각해보다가 몇 년 전 인기를 끌었던 어느 프로그램을 떠올리게 됐다. 챗GPT로 대표되는 대규모 언어모델(LLM)들이 빠지기 쉬운 것과 비슷한 오류란 생각이 든 때문이다.

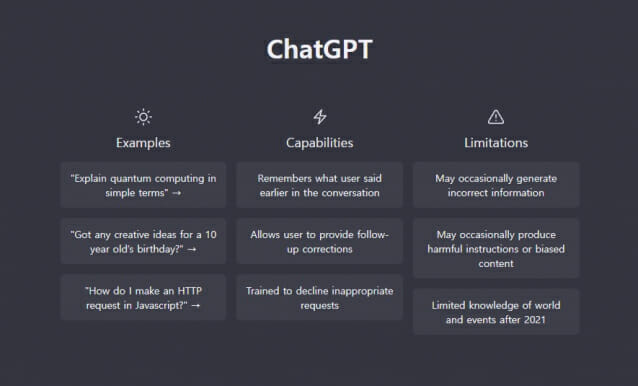

챗GPT를 써 본 많은 사람들은 ‘뛰어난 요약 능력’에 감탄하곤 한다. 카이스트 김대식 교수는 아예 챗GPT와 다양한 주제로 대화한 내용을 책으로 묶어 내기도 했다. 영어로 문답을 주고 받은 내용을 정리한 그 책을 읽어보면, 챗GPT의 학습 능력이 만만치 않다는 사실을 알 수 있다.

그러다보니 언론도 챗GPT 열풍을 피해가긴 힘들다는 전망이 힘을 얻고 있다. 벌써부터 챗GPT가 기자들이 하는 일을 상당 부분 대신할 것이란 얘기가 나오고 있다. 기자들이 일하는 방식을 생각해보면, 꽤 많은 부분을 대체할 수 있을 것 같긴 하다.

언론은 챗GPT를 어디까지 허용해야 할까? 언뜻 간단한 질문처럼 들린다. 그런데 찬찬히 따져보면, 간단한 문제가 아니다. 한계를 정하는 것이 쉬운 일이 아니기 때문이다.

이런 질문에 답을 하기 위해설도, 언론 역시 챗GPT를 비롯한 생성 AI 기술과 공존하는 방법에 대한 고민을 해야 할 때가 됐다. 그런 측면에서 디지털 문화 전문 매체 와이어드(WIRED)가 최근 공개한 생성 AI 사용 기준은 꼼꼼하게 따져볼 가치가 있는 것 같다.

미국 미디어 전문매체인 니먼랩은 “와이어드가 뉴스 매체로는 최초로 공식적인 AI 정책을 내놨다”면서 주요 내용을 소개했다.

와이어드는 AI가 기사나 칼럼을 쓰거나 편집하는 것은 허용하지 않기로 했다. 이 원칙은 기사 같은 긴 글 뿐 아니라 용어 설명 같은 간단한 문구에도 적용된다. 이메일 뉴스레터 역시 AI로 작성하지 못하도록 했다.

이에 대해 와이어드는 “현재 AI 도구들은 오류가 많을 뿐 아니라 편견으로부터도 자유롭지 못하다”고 지적했다. 게다가 생성 AI는 여기 저기 흩어져 있는 글들을 적당히 짜깁기하는 경우도 적지 않다. 이런 부분들이 언론의 원칙에 어긋날 가능성이 많다는 것이다.

반면 AI를 활용해 제목이나 소셜 미디어 글의 힌트를 얻는 것은 적극 권장한다. 기사나 기획 아이디어를 얻는 것도 허용한다.

하지만 AI로 이미지나 영상을 생성하는 것은 금지한다. 인터넷에는 이미지 생성 AI프로그램 달리(DALL-E)로 만든 영상들이 꽤 많다. 그런데 이 영상들은 법적인 문제를 야기할 가능성이 적지 않다. 와이어드 역시 이런 점을 감안해 이미지 생성 AI 프로그램 사용을 금지시켰다.

이런 기준은 AI 기술 활용이란 관점에서 보면 굉장히 소극적이고 보수적이다. 와이어드 역시 그 부분을 인정한다. 그러면서 “기술 발전 상황에 따라 정책을 수정할 계획이다”고 밝히고 있다.

■ 저널리즘은 챗GPT를 감당할 수 있을까

와이어드의 정책을 보면 ‘생성 AI는 아직 저널리즘에 적용하기엔 시기 상조다’는 생각이 짙게 배어 있다. 이런 관점이 현실과 동떨어져 있다고 지적하긴 쉽지 않아 보인다. 실제로 AI 기사 작성 실험에선 한계가 많이 드러났기 때문이다.

대표적인 것이 미국 IT 전문매체인 씨넷의 AI 기사 작성 실험이다. 씨넷은 AI가 작성한 기사에서 오류가 많이 발견된 사실을 확인하고 결국 실험을 중단했다.

그렇다고 해서 저널리즘은 인간 고유의 영역이라는 얘기는 아니다. 실제로 기자들이 하고 있는 일을 생각하면, 대체 가능한 부분이 엄청나게 많아 보이기 때문이다.

그렇다면 챗GPT 시대 기자들은 어떤 역할을 해야 할까? 그리고 챗GPT(로 대표되는 생성AI)는 어디까지 활용해야 할까?

나는 기자들은 앞에서 소개한 예능 프로그램 PD 같은 역할을 소화할 수 있어야 한다고 생각한다. 다양한 사실들을 종합하고, 그 속에서 새로운 의미를 찾아낼 수 있어야 한다는 의미다. 새로운 사실을 발굴하고, 참신한 기획 아이템을 발굴하는 능력도 꼭 필요한 덕목이다. 그런 측면에서 '발로 뛰는 기자'의 가치는 절대 줄어들지 않을 것이다.

관련기사

- 글 잘 쓰는 챗GPT, 기자의 미래를 위협하다2023.02.02

- 챗GPT 열풍과 '헐리우드 키드의 생애'2023.02.08

- 챗GPT, 21세기 대학에 경고장을 보내다2023.01.19

- 챗GPT가 취업 면접 코칭해준다2023.03.06

이런 능력이 감당하는 범위 안에서 챗GPT를 활용해야 한다는 것이다. 결국 기자들은 지금보다 훨씬 더 전문적인 지식과 정보 종합 능력이 요구된다는 얘기인 셈이다.

안 그래도 녹록지 않은 저널리즘의 미래에, 챗GPT는 한 가지 숙제를 더 얹어준 것 같다. 어쩌겠는가? 그게 기술이 기자들에게 요구하는 의무라면, 감당하는 수 밖에.