페이스북 모회사인 메타도 챗GPT 출시 이후 각광을 받고 있는 생성인공지능(AI) 경쟁에 출사표를 던졌다.

메타가 24일(현지시간) AI 기반 대용량언어모델(LLM)인 LLaMa를 공개했다고 아스테크니카를 비롯한 외신들이 보도했다.

특히 메타가 새롭게 선보인 LLaMa는 용량이 다른 모델의 10분의 1 수준에 불과해 스마트폰 같은 개인용 기기에서도 생성 AI 기능을 구현할 수 있는 것으로 알려져 관심이 쏠리고 있다.

LLM은 텍스트를 읽고 요약할 뿐 아니라 사람처럼 말하고 쓸 수도 있는 쓰는 AI 툴이다. 오픈AI가 최근 출시한 챗GPT와 구글의 새 검색 엔진 ‘바드'가 대표적인 사례다.

메타는 이날 새롭게 내놓은 LLaMa가 오픈AI의 GPT-3에 비해 용량이 10분의 1에 불과하지만 성능은 훨씬 더 뛰어나다고 강조했다.

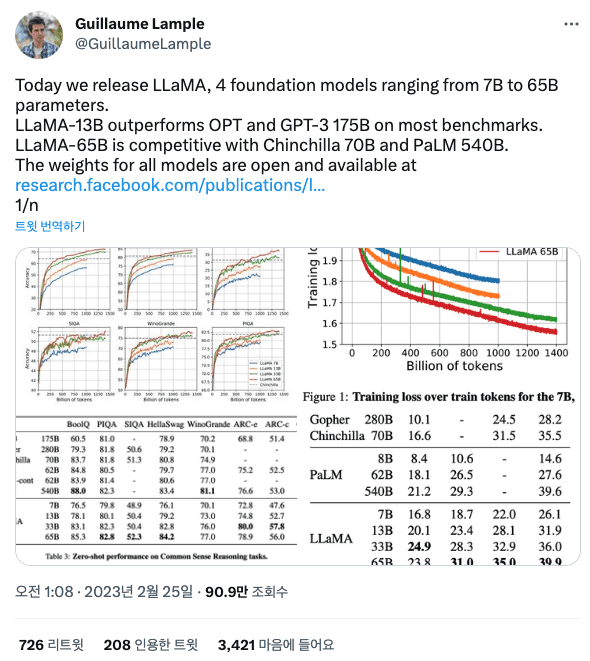

용량을 줄인 덕분에 PC나 스마트폰 같은 개별 기기에서도 챗GPT 같은 서비스를 구현할 수 있다고 설명했다. 메타의 새 언어 프로그램은 매개변수가 70억~650억 개 수준인 것으로 알려졌다. 반면 오픈AI의 GPT-3는 매개 변수가 1천750억 개에 이른다.

메타는 위키피디아, C4 등 대중적으로 공개돼 있는 데이터를 활용해 LLaMa를 훈련시켰다고 밝혔다. 또 과학자와 엔지니어들이 AI 응용 프로그램 연구에 활용할 수 있도록 오픈소스로 공개할 계획이라고 덧붙였다.

관련기사

- 챗GPT 열풍, MSP 수혜주로 부상2023.02.24

- 챗GPT, 아마존 킨들서 책 200권 이상 등록2023.02.22

- 통신 3사 '챗GPT' 열풍 가세...AI 고도화 집중2023.02.17

- ‘챗GPT’ 열풍에 AI 챗봇 스타트업 ‘주목’2023.02.17

이번 프로젝트에 참여한 기욤 램플은 "LLaMA-13B는 대부분의 벤치마크 테스트에서 OPT나 GPT-3보다 뛰어난 성능을 발휘했으며, LLaMA-65B도 친칠라 70B나 PaLM 540B에 필적할 경쟁력을 보여줬다"고 강조했다.

그는 또 “PaLM이나 GPT-3 같은 다른 언어 모델과 달리 공개된 데이터만을 이용했으며, 오픈소스로 공개하기로 했다”고 덧붙였다. 메타의 LLaMa는 깃허브에서 내려받을 수 있다.