OTT와 같은 방송에서 흘러나오는 음성이 곧바로 자막으로 나온다. 방송사가 프로그램에 자막을 덧입히지 않더라도 인공지능 시스템이 인식한 방송 프로그래의 음성을 자동으로 글자로 바꿔 화면에 표출시키는 방식이다.

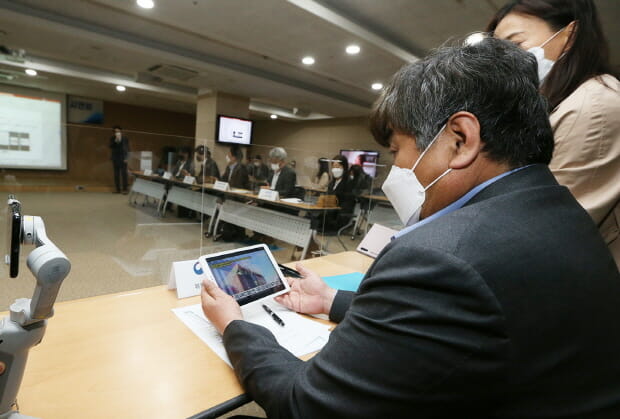

방송통신위원회와 과학기술정보통신부는 20일 서울 여의도 이룸센터에서 41회 장애인의 날을 맞아 두 부처가 협업해 온 ‘AI 기술을 활용한 자막 수어방송 자동변환 기술’ 시연회를 열었다.

이날 시연된 기술은 한국정보통신기술협회(TTA)가 개발한 음성-자막 자동변환 기술과 한국전자통신연구원(ETRI)이 개발한 ‘장애인방송 시청 지원 감성표현 서비스’ 기술이다.

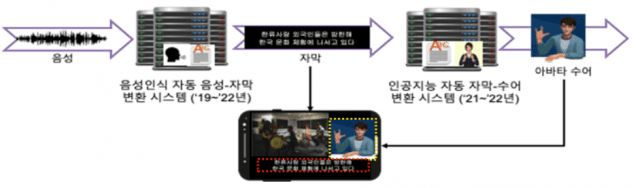

우선 음성-자막 자동변환 기술은 AI 스피커에서 널리 쓰이는 음성인식 기술을 활용해 스마트폰이나 태블릿에서 음성을 자막으로 자동 변환해 화면에 표시해 주는 것으로, 청각장애인 등이 인터넷 동영상을 감상할 때 자막을 지원하는 기술이다.

방송 자막은 프로그램 편집 단계에서 사람이 일일이 타이핑한 글자를 덧입히는 식으로 만들어진다. 때문에 방송 제작 편집 단계에서 자막을 만들지 않으면 청각장애인은 방송 화면만 볼 수밖에 없다.

반면 이 기술은 방송 제작 단계가 아니라 시청 단계에서 흘러나오는 음성을 곧바로 자막으로 만들기 때문에 어떤 방송에도 적용할 수 있다.

이를테면 유튜브 영상을 스마트폰에 띄운 뒤 자동변환 앱을 띄우면 디스플레이 하단에 출연자의 목소리에 맞춰 자막이 만들어진다. 자막의 크기나 색, 폰트 등을 바꿀 수 있고 터치를 통해 자막의 위치를 바꿀 수도 있다.

이 기술 개발은 지난 2018년 국민 참여 제안으로 시작됐다.

이후 정부 예산이 반영된 뒤 청각장애인용 자막 수어방송 시스템 개발 사업에 착수해 안드로이드와 iOS 버전의 시제품이 개발됐다.

우선 1단계로 음성인식 기술을 활용해 자막을 자동으로 생성하는 시스템을 개발했고, 현재 2단계에서는 음성을 자막으로 바꾸는 과정에서 동시에 수어로 바꾸는 애니메이션을 자동 생성하는 시스템을 개발하고 있다.

수어통역사가 현장에서 음성을 듣고 수어를 하지 않고 아바타로 구현한 애니메이션이 음성인식을 기반으로 자막과 함께 수어도 보여주는 식이다.

방통위와 과기정통부는 2023년까지 음성-자막-수어 자동변환 시스템 개발하고, 이를 연계해 감성표현이 가능한 아바타 수어 방송활용을 목표로 추진하고 있다.

관련기사

- 방통위, 청각장애인용 ‘음성-자막 변환’ 앱 시범 서비스2020.08.31

- 네이버, 동영상 뉴스 자막 AI로 자동 생성2020.01.03

- 수어 영상으로 만든 코로나 예방수칙 '눈길'2020.07.21

- 고정된 수어방송, 크기·위치 바꾸며 본다2019.07.04

한상혁 방통위원장은 “비대면 사회가 빠르게 일상에 자리를 잡으면서 디지털 미디어가 우리 삶에서 차지하는 비중이 커지고 있지만 청각장애인의 미디어 접근은 더욱 어려워지고 있다”며 “미디어 소외계층의 요구를 반영하지 못한 디지털 미디어 환경은 불평등을 더욱 고착화시킬 수 있다”고 말했다.

이어, “장애인의 미디어 접근은 당연한 권리이며, 이를 위한 정책을 마련하는 것은 정부의 의무”라면서 “상반기 중 미디어 소외계층 종합 지원 계획을 발표할 예정으로 누구나 미디어를 충분히 누릴 수 있도록 차질 없이 준비하겠다”고 강조했다.