페이스북이 기존 인공지능(AI) 학습용 시스템에 사용된 '빅서(Big Sur)'에 비해 두 배 빠른 새 서버 디자인을 공개했다. 페이스북에 올라온 이미지에서 사물과 사람의 얼굴을 인식하거나 텍스트 번역, 사진이나 동영상 등 콘텐츠에 담긴 내용을 AI가 보다 정확하게 이해할 수 있도록 효율적으로 서버를 쓰는 방안을 마련한 것이다.

8일(현지시간) 페이스북에 따르면 빅베이슨은 이전 대비 30% 많은 학습모델을 돌릴 수 있다. 특히 표준화된 인공신경망 모델에 대한 테스트에서는 처리속도가 2배가 빨라졌다고 설명했다.

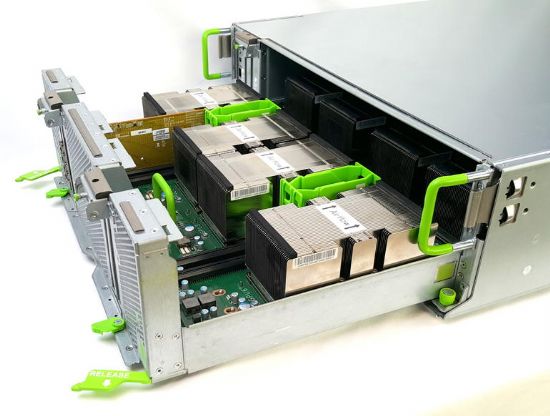

빅베이슨은 메모리 용량을 이전 서버가 가진 16GB로 늘려 더 많은 연산능력을 갖췄다. 8개 엔비디아 테슬라 P100 그래픽처리프로세서(GPU) 액셀러레이터와 CPU와 GPU 사이에 데이터를 넘기는 부분에서 엔비디아가 보유한 인터커넥트 기술을 활용해 처리속도를 높였다.

또한 액셀러레이터와 내부 섀시, 외부 섀시를 분리해 더 빠르게 서버를 구축하거나 용량을 확장, 축소할 수 있게 했으며 유지보수 시간도 줄이도록 했다.

빅베이슨과 빅서는 모두 엔비디아가 제공하는 그래픽처리프로세서(GPU)로 구성된 서버로 AI를 학습시키기 위한 대용량 네트워크로 활용된다.

페이스북은 가까운 시일 안에 이러한 서버 디자인을 일반에 공개할 계획이다. 이 회사는 데이터센터 하드웨어와 소프트웨어를 공유하고, 이를 활용해 협업하기 위해 마련된 오픈컴퓨트프로젝트에 참여하고 있는 만큼 누구나 자사에서 쓰는 서버 설계 노하우를 활용할 수 있도록 공개한다는 방침이다.

페이스북은 자사 서비스에 로그인하는 순간부터 사용자들이 AI를 활용하게 된다고 말한다. 빅베이슨을 포함한 페이스북 데이터센터 이니셔티브에서 테크니컬 프로그램 매니저를 맡고 있는 케빈 리는 "만약 당신이 페이스북에 로그인했다면 이미 우리가 개발한 AI 시스템 중 일부를 사용하고 있는 것"이라고 설명했다.

관련기사

- 페이스북과 트위터 차이는 어디서 왔나2017.03.09

- 페이스북, 메신저에 '싫어요' 추가하나2017.03.09

- 페이스북, AI 활용해 자살 예방한다2017.03.09

- 페이스북 동영상 삼성 스마트TV로 바로 본다2017.03.09

이를 테면 페이스북 친구를 태깅해서 실시간 방송을 포함한 동영상을 분류할 때 AI 시스템은 더 많은 다른 사용자들이 이러한 영상을 올리고, 소비하도록 돕는다.

페이스북은 최근에는 AI 알고리즘을 활용해 시각장애인들이 뉴스피드에 올라온 사진을 묘사한 내용을 스마트폰에서 음성으로 들을 수 있도록 했다. 또한 최근에는 심각한 우울증 환자 등 정신 건강에 문제를 겪고 있는 사용자들을 분간해 도움을 줄 수 있도록 하는 패턴인식소프트웨어도 제공 중이다.