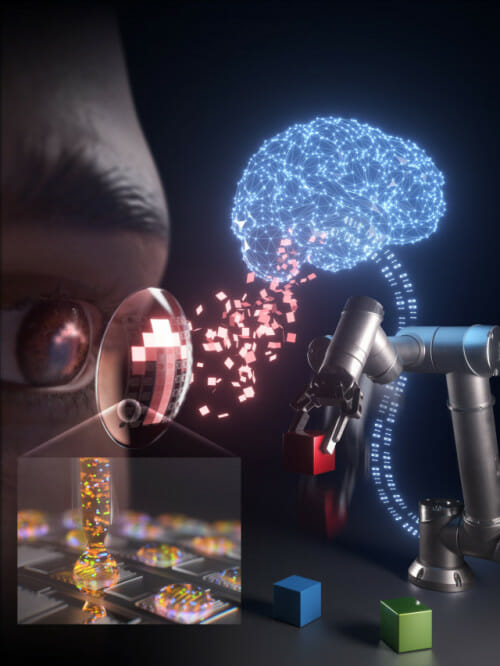

센서를 붙인 콘택트 렌즈를 끼고 안구를 굴리면, 로봇 팔이 그대로 따라 움직이는 기술이 개발됐다. 무겁고 복잡한 기존 확장현실(XR) 기기를 대신할 차세대 인간-기계 인터페이스 기술이다.

UNIST는 정임두 기계공학과 교수(인공지능대학원 겸직) 연구팀이 센서를 렌즈에 직접 인쇄하는 특수 기술과 센서 저해상도 신호를 고해상도로 복원하는 AI 기술을 결합한 스마트 콘택트렌즈를 개발했다고 15일 밝혔다.

연구팀은 이 기술로 로봇 팔을 원격 제어하는데 성공했다.

연구팀은 스마트 렌즈 위에 100개(10x10)의 빛 검출 센서를 집적했다. 이 센서가 눈이 움직일 때마다 달라지는 빛 분포를 읽어내 시선 방향을 추적하는 원리다.

위·아래·좌·우는 물론 대각선 방향까지 구분할 수 있다. 안구 깜박임으로 물건을 집을 수도 있다.

연구진은 둥근 렌즈 표면에 센서를 직접 프린팅할 수 있도록 ‘메니스커스 픽셀 프린팅(MPP)’ 기술을 개발했다. 노즐 끝에 맺힌 센서 원료 잉크를 렌즈 표면에 콕콕 찍어내는 형태의 기술이다.

메니스커스는 액체의 볼록하거나 오목한 곡면을 말하는데, 이 곡면 덕분에 잉크가 배출되는 힘과 잉크 퍼짐을 막는 힘이 균형을 이뤄 잉크를 원하는 양만큼 찍어낼 수 있다.

잉크를 건조하면 빛을 감지하는 페로브스카이트 물질만 남아 센서 역할을 하게 된다.

정임두 교수는 "일반 센서 제작과 달리 센서 패턴을 새기기 위한 마스크가 필요 없고 다양한 안구 곡률에 맞춰 센서를 인쇄할 수 있어 개별 맞춤형 렌즈를 만들 수 있는 장점이 있다"고 설명했다.

렌즈라는 작은 공간 탓에 신호 해상도가 떨어지는데, 이 문제는 인공지능 기술로 해결했다. 실제 100개 센서가 있지만, 딥러닝 기반 초해상도 기술을 적용하면 최대 6,400개(80x80)의 센서가 있는 것과 같은 신호 데이터를 얻을 수 있다. 재구성에 필요한 시간도 0.03초로 짧다. 로봇 팔에 정보 전달이 거의 실시간에 가깝다.

안구 모형을 이용한 실험에서, 눈동자 움직임만으로 물체를 집어 옮기는 동작까지 확인했다. 방향 인식 정확도는 99.3% 수준을 기록했다.

이번 연구는 공병훈, 김도현 UNIST 기계공학과 연구원이 제1저자로 참여했다.

연구를 총괄한 정임두 교수는 “별도 컨트롤러없이 인간의 시각 정보를 로봇 제어 신호로 직접 변환하는 고도화된 인간-기계 상호작용(HRI) 시스템 구현이 가능함을 증명했다”고 말했다.

관련기사

- 산업용 로봇 팔 떨림, SW로 해결…"현장 바로 적용 가능"2026.01.26

- 조선소 빠삭한 'AI' 만든다…HD현대-UNIST-울산대 맞손2025.11.20

- UNIST 아산화질소 99.98% 저온 분해 기술 개발…생산단가 기존대비 8배 저렴2025.10.21

- [1분건강] 봄철 미세먼지·건조한 공기 속 ‘각막’ 손상 주의2026.03.25

정 교수는 또 “차세대 초경량 XR 인터페이스 장치로서 눈의 움직임만으로 다양한 전자 기기를 정밀하게 제어할 수 있다는 점에서, 증강현실 기반 산업용 로봇 원격 제어, 재난·재해 환경에서의 탐사 로봇 운용, 국방 분야의 무인체계 및 드론 조종, 의료 및 재활 지원 시스템, 스마트 모빌리티 인터페이스 등 다양한 분야로 확장될 수 있는 잠재력을 지닌다“고 밝혔다.

연구 결과는 재료 과학 분야 국제 학술지 ‘어드밴스드 펑셔널 머티리얼즈((IF19.0)에 게재됐다. 조만간 최신호 전면 표지 논문으로 출판될 예정이다.