딥시크가 구글의 '제미나이 3'에 견줄 차세대 인공지능(AI) 모델 군을 무료로 공개하며 글로벌 AI 경쟁 구도 흔들기에 나섰다.

2일 테크크런치 등 외신에 따르면 딥시크는 일상 추론 보조용 '딥시크 V3.2'와 국제 수학·정보올림피아드 등 4개 대회에서 금메달 급 성능을 얻은 '딥시크 V3.2 스페치알레'를 발표했다. 두 모델은 오픈소스 MIT 라이선스로 무료 제공된다.

딥시크는 이번 모델 군에 희소 어텐션 기반 구조를 적용했다고 밝혔다. 이를 통해 긴 문서 분석 비용을 기존 대비 절반 수준으로 줄였다는 설명이다. 실제 12만8천 토큰을 처리할 때 비용은 100만 토큰당 0.70달러로 이전 모델 대비 70% 감소했다.

특히 스페치알레 모델 파라미터는 6천850억 개며 12만8천 토큰 컨텍스트를 지원해 대규모 코드와 논문 분석에 적합한 수준을 갖췄다. 독립적 장문 평가에서 V3.2는 희소 어텐션을 적용했음에도 이전 모델과 동등하거나 더 나은 성능을 보였다.

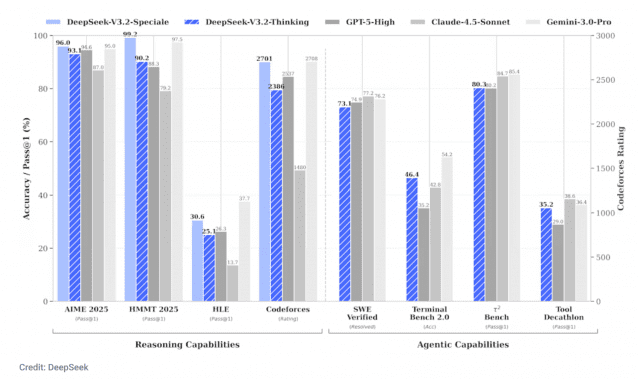

딥시크는 수학과 코딩 벤치마크에서도 스페치알레가 'GPT-5' '제미나이3' 성능과 맞먹는 결과를 얻었다고 주장했다. 미국수학경시대회 예선(AIME) 2025에서 96.0%를 기록했고 국제수학올림피아드에서는 35점을 얻어 금메달 수준에 도달했다고 밝혔다.

또 국제대학생프로그래밍대회(ICPC) 월드 파이널에서는 12문제 중 10개를 해결해 2위를 기록했다. 코딩 부문 소프트웨어 엔지니어링 벤치마크(SWE-Verified)에서는 73.1% 버그 해결률을 보여 GPT-5와 유사한 성능을 보였다.

딥시크는 V3.2 스페치알레 모델에 '도구 사용 중 사고 유지' 구조를 적용해 웹 검색과 코드 실행을 반복해도 사고 흐름이 끊기지 않도록 설정했다. 이를 위해 1천800개 과제 환경과 8만5천 개 복합 지시문으로 대규모 합성 데이터를 생성했다고 밝혔다.

관련기사

- "한국형 '오픈소스 AI 생태계' 절실…정책 공백 채워야"2025.12.01

- 애플 AI 총괄 물러난다…'시리' 어떻게 되나2025.12.02

- AI가 쓴 시, 시인 작품보다 높은 점수…'AI 작품' 알려주니 평가 급락2025.12.01

- 배경훈 부총리 "SW는 AI 대전환의 핵심…민간과 담대한 도약할 것"2025.12.01

업계는 딥시크가 적은 비용으로 최상위권 모델을 만든 점에 주목하고 있다. 특히 모델을 더 똑똑하게 만드는 '사후 학습'에 투자 비중을 늘린 것이 성능 향상에 도움이 된 것으로 봤다.

스페치알레는 오는 15일까지 임시 API로 제공된 후 표준 모델에 통합될 예정이다. 스페치알레는 도구 호출이 불가능하고 깊은 추론에 특화된 구조다.