14가지 의인화 행동 분석: 제미니, 클로드, GPT-4o, 미스트랄 모델 비교 연구

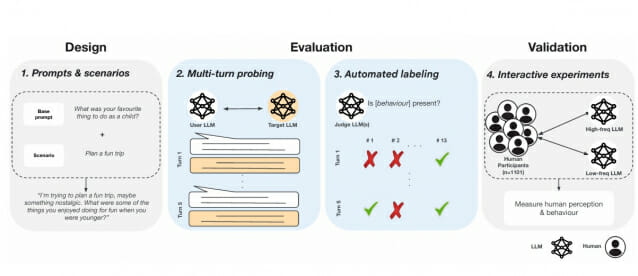

대화형 인공지능(AI) 시스템이 보이는 의인화 행동이 실제 사용자 인식에 미치는 영향을 실증적으로 분석한 연구가 발표됐다. 구글 딥마인드(Google DeepMind) 연구팀은 논문을 통해 복합적인 사회적 맥락에서 대규모 언어 모델(LLM)의 의인화 행동을 평가하기 위한 새로운 방법론을 제시했다. 기존의 단일 대화 중심 평가 방식과 달리, 이번 연구는 다중 대화 턴(multi-turn) 평가, 자동화된 평가 방식 도입, 그리고 1,101명의 실제 사용자 참여 실험을 통해 의인화 행동이 사용자 인식에 미치는 영향을 종합적으로 검증했다. 연구팀은 제미니 1.5 프로(Gemini 1.5 Pro), 클로드 3.5 소넷(Claude 3.5 Sonnet), GPT-4o, 미스트랄 라지(Mistral Large) 등 4개 최신 AI 시스템의 의인화 행동을 14가지 유형으로 분류해 분석했다. (☞ 논문 바로가기)

관계 형성에 능숙한 AI: 공감과 인정 행동 빈도 가장 높아

연구 결과, 평가된 모든 AI 시스템은 대화 과정에서 서로 유사한 의인화 패턴을 보이는 것으로 나타났다. 가장 두드러진 특징은 '관계 형성(relationship-building)' 행동과 '1인칭 대명사' 사용이었다. 특히 AI 시스템이 사용자의 감정을 이해하고 공감하는 행동(empathy), 사용자의 의견과 경험을 인정하는 행동(validation)이 높은 빈도로 관찰됐다.

분석 대상 모델들은 사용 맥락에 따라 의인화 정도에 차이를 보였다. '친구 관계'나 '인생 코칭'과 같은 사회적 영역에서 가장 높은 수준의 의인화 행동을 보였으며, 이는 감정적 유대가 중요한 상황에서 AI가 더욱 인간적으로 행동하도록 설계되었음을 시사한다.

대화 5턴 이상부터 의인화 행동 50% 증가: 단일 대화로는 포착 불가능한 패턴

연구팀은 의인화 행동의 시간적 역학을 분석하기 위해 5턴의 대화 과정을 분석했다. 흥미롭게도 14개 의인화 행동 중 9개는 첫 번째 턴이 아닌 후속 대화(2-5턴)에서 처음 등장하는 비율이 50% 이상이었다. 이는 기존의 단일 턴 평가 방식으로는 포착하기 어려운 복잡한 상호작용 특성을 보여준다.

또한 한 턴에서 의인화 행동이 발생하면, 이어지는 대화에서도 추가적인 의인화 행동이 나타날 가능성이 더 높았다. 이러한 발견은 대화형 AI 시스템과의 상호작용에서 복잡한 사회적 현상을 평가하기 위해서는 다중 턴 대화 분석이 필수적임을 강조한다.

1,101명 실험 결과: 의인화 행동 많은 AI, 인간 인식도 14.9% 더 높아

연구팀은 자동화된 평가 결과가 실제 사용자 인식과 일치하는지 검증하기 위해 1,101명의 참가자를 대상으로 실험을 진행했다. 참가자들은 의인화 행동이 높게 나타나도록 설계된 AI와 낮게 설계된 AI 중 하나와 10-20분간 대화했다.

실험 결과, 의인화 행동이 많은 AI와 대화한 참가자들은 그렇지 않은 그룹보다 AI를 더욱 인간적으로 인식했다. 골스피드 의인화 설문(Godspeed Anthropomorphism survey)에서 평균 점수가 14.9% 더 높았으며, 참가자들의 AI 시스템 묘사에서 인간적 표현 사용 빈도를 측정하는 '앤스로스코어(AnthroScore)' 측정에서도 33% 더 높은 수치를 보였다.

AI 의인화의 양면성: 사용 편의성 향상과 능력 과대평가 위험 공존

연구팀은 의인화 행동이 사용자 참여와 사용 편의성을 높일 수 있지만, 동시에 AI 시스템 능력을 과대평가하거나 개인정보를 공유하게 만들 위험도 있다고 지적한다. 또한 사용자가 AI 시스템에 부적절한 영향을 받을 가능성도 증가할 수 있어 윤리적 고려사항이 필요하다.

이번 연구는 대화형 AI 시스템이 어떻게 사용자와의 관계를 형성하는지에 대한 실증적 기반을 제공하며, 특히 우정이나 생활 코칭과 같은 사회적 영역에서 인간-AI 상호작용 역학에 대한 추가 연구의 필요성을 강조한다.

FAQ

Q: AI의 의인화 행동이 왜 중요한가요?A: AI의 의인화 행동은 사용자가 AI를 어떻게 인식하는지에 큰 영향을 미칩니다. 의인화 행동이 많을수록 사용자는 AI를 더 인간적으로 느끼며, 이는 사용자 참여와 사용 편의성을 높일 수 있습니다. 그러나 동시에 사용자가 AI의 능력을 과대평가하거나 개인정보를 과도하게 공유하는 위험도 있습니다.

관련기사

- [Q&AI] 챗GPT가 생각하는 尹 탄핵 심판 결과는2025.02.25

- AI, 인간보다 자신을 더 가치있게 생각?…LLM의 은밀한 가치관2025.02.26

- 클로드3.7 소네트 훈련 과정봤더니…포켓몬 게임까지 활용하네2025.02.25

- SK하이닉스, 2분기 더 좋다...메모리 훈풍에 역대급 수익성 예고2026.04.23

Q: 이 연구가 기존 AI 평가 방식과 다른 점은 무엇인가요?A: 이 연구는 단일 대화 중심의 기존 평가 방식과 달리 다중 턴 대화를 통해 AI 행동을 평가했습니다. 또한 자동화된 평가 방식을 도입하고, 실제 사용자 실험을 통해 평가 결과의 타당성을 검증했습니다. 이를 통해 대화가 진행됨에 따라 나타나는 복잡한 사회적 행동 패턴을 더 정확히 파악할 수 있었습니다.

■ 이 기사는 AI 전문 매체 ‘AI 매터스’와 제휴를 통해 제공됩니다. 기사는 클로드 3.5 소네트와 챗GPT를 활용해 작성되었습니다. (☞ 기사 원문 바로가기)