"인공지능(AI) 모델의 추론 능력과 견고함은 일반인공지능(AGI) 시대 필수 요소입니다. 그래야 기술 발전과 모델 안전성까지 지킬 수 있습니다. 오픈AI는 두 부분에 가장 큰 투자를 하고 있습니다. 이런 투자로 GPT-o1과 o3를 출시했습니다."

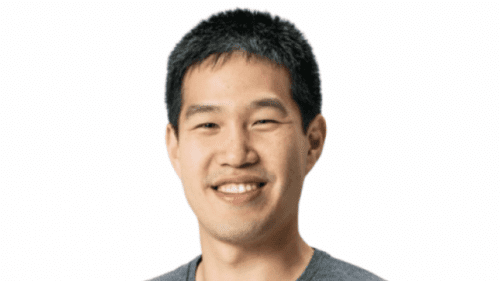

오픈AI 마크 첸 최고연구책임자(CRO)는 4일 서울대 해동첨단공학관에서 학교 산하 AI 연구원(AIIS)이 주최하는 'Q&A 위드 오픈AI'에서 이같이 밝혔다. 첸 CRO는 6년 동안 오픈AI에서 근무했다. 최근 출시된 o1과 o3 개발을 주도한 인물로 알려져 있다.

첸 CRO은 서울대 학생들과 오픈AI의 최신 모델 특장점과 AI 안전성, AGI 핵심 요소 등을 논의했다. 이날 사회는 장병탁 AIIS 원장이 맡았다. AIIS는 저출산·고령화 시대에 대응할 수 있는 AGI 원천 기술을 개발 중인 AI 연구기관이다. 연구원 약 3천명이 AIIS에서 근무하고 있다.

첸 CRO는 AGI 전망에 대한 견해를 밝혔다. AGI를 어떤 관점에서 보느냐에 따라 전망은 제각각일 것이라고 주장했다. 우선 경제적 관점에서 봤을 때 현재 AGI 시대 초기에 접어들었다고 했다.

그는 "오픈AI 제품이 우수한 경제적 가치를 제공하고 있다"며 "경제적 관점에서 AGI는 이미 진행 중"이라고 덧붙였다.

첸 CRO는 기술적으로도 AGI 시대에 가까워지고 있다고 밝혔다. 모델이 지능을 수치화한 벤치마크에서 과거에 비해 우수한 성과를 내고 있다는 것을 근거로 들었다.

그는 "몇 년 전까지만 해도 AI 모델 주요 미션은 초등학생 수학 문제를 푸는 것에 불과"했다며 "현재는 박사 수준의 문제를 이미 해결한 상태"라고 설명했다. 그러면서 "앞으로 개발될 모델 수준은 상상 이상일 것"이라고 내다봤다.

첸 CRO는 오픈AI의 다음 스텝에 대해 언급했다. 기술적으로 모델 견고성과 추론에 가장 큰 투자를 하고 있다고 밝혔다. 모델이 AGI 시대에 살아남으려면 추론 능력과 견고성을 핵심 요소로 갖춰야한다는 판단에서다.

그는 "현재 사람이 AI 에이전트 시스템에 의존할 수 없는 이유는 이 기술을 충분히 신뢰하지 못하기 때문"이라며 "이를 극복하려면 모델에 견고성과 높은 추론성을 갖춘 자율 시스템을 탑재해야 한다"고 밝혔다. 그러면서 "모델이 견고하고 추론성이 높으면 안전성까지 잡을 수 있다고" 덧붙였다.

"o1·o3로 모델 신뢰성 이미 검증…안전한 AI 개발 집중할 것"

첸 CRO는 이런 투자를 통해 얻은 주요 성과로 GPT-o1과 o3를 예시로 들었다. o1은 지난해 11월, o3는 지난달 공개된 오픈AI 추론 모델이다.

그는 "모델 출시 후 기능을 개선했다는 피드백을 받았지만 근본적으로 안전성도 높였다"며 "개인적으로는 안전성에서 가장 놀라움을 느꼈다"고 말했다.

그는 두 모델과 이전 GPT 시스템 차이점을 설명했다. 이전 시스템은 사용자 명령어에 즉시 응답하는 식으로 텍스트와 이미지를 생성했다. 환각현상 위험성에 노출되기 쉬운 상태였다. GPT를 악용해 사이버 범죄 저지르기도 비교적 수월했다.

관련기사

- 카카오, '카나나'에 오픈AI 최신 기술 가져다 쓴다2025.02.04

- [유미's 픽] 中 딥시크에 놀랐나…샘 알트먼, 韓·日·印서 오픈AI 생태계 확대 안간힘2025.02.04

- 오픈AI, 韓 AI 연구진 만난다…서울대서 비공개 행사 개최2025.02.03

- 오픈AI-카카오 협력 가능성 제기…네이버 '소버린 AI'에 도전장 될까2025.02.03

반면 o1과 o3는 자기반성이 가능한 인지 기능을 갖췄다. 이전 시스템과 달리 스스로 생각할 수 있는 시간도 가질 수 있는 이유다. 응답은 상대적으로 느려도 전보다 정확한 답변을 낼 수 있다. 사이버 공격이나 비윤리적 명령어를 차단할 수 있는 능력이 업그레이드된 셈이다.

첸 CRO는 오픈AI 모델은 여전히 갈 길이 멀다고 말했다. 100% 안전성을 보장할 수 없다는 설명이다. 그는 "현재 내부적으로 레드팀 등 안전을 담당하는 부서에 꾸준한 기술적 투자를 진행하고 있다"며 "기술뿐 아니라 안전성 향상에도 집중할 것"이라고 덧붙였다.