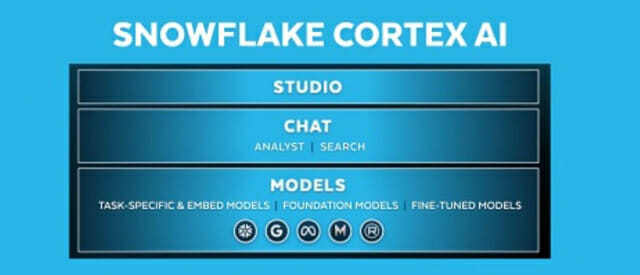

"애플리케이션 개발 플랫폼 '스노우플레이크 코텍스AI'에 오픈소스 모델 '라마 3.1'을 본격 추가했습니다. 기업은 코텍스AI로 앱 개발을 대규모로 원활히 진행할 수 있습니다. 현재 국내 10대 대기업이 이 플랫폼을 선택한 이유입니다."

최기영 스노우플레이크 한국 지사장은 9일 서울 강남 파크 하얏트에서 열린 '스노우플레이크 월드투어 서울'에서 새 거대언어모델(LLM) 호스팅 계획을 이같이 밝혔다. 이를 통해 코텍스AI는 엔터프라이즈 고객들에 원활한 인공지능(AI) 서비스를 추가 공급할 수 있다.

스노우플레이크 서비스에 탑재된 라마3.1은 오픈소스 LLM이다. 메타의 라마 제품군 중 가장 큰 모델로, 파라미터 405억개로 이뤄졌다. 코텍스AI는 라마3.1로 실시간 고처리량 추론을 진행하고 자연어처리(NLP)와 생성형 AI 앱 개발을 돕는 환경을 제공한다.

최기영 지사장은 "코텍스AI는 라마3.1로 더 빠른 시간 내에 높은 추론력을 구현할 수 있다"고 강조했다. 기존 오픈소스 솔루션보다 엔드투엔드(end-to-end) 지연시간은 최대 3분의 1로 줄고, 처리량은 1.4배 높아졌다는 이유에서다.

최 지사장은 스노우플레이크 AI 리서치팀이 라마3.1 출시와 더불어 LLM 추론과 파인튜닝 시스템 최적화 스택을 오픈소스화하고 있다는 점도 설명했다. 이를 통해 수천억개 매개변수로 이뤄진 모델 접근성을 높이고 파인튜닝 시스템에 필요한 솔루션을 구축할 방침이다.

최 지사장은 스노우플레이크가 LLM 추론과 파인튜닝 시스템 최적화를 위해 노력 중이라고 밝혔다. 고급 병렬화 기술과 메모리 최적화를 통해 복잡하고 고비용 인프라 없이 효율적인 AI 처리가 가능하도록 만들기 위해서다.

그는 "라마 3.1 405B로 스노우플레이크의 시스템 스택은 GPU 노드 하나만으로 실시간의 고처리량 성능을 발휘할 수 있다"고 말했다. 이런 환경에서 개발자들은 적은 개수로 이뤄진 GPU 상에서 복잡한 기술로 라마 3.1 405B를 파인튜닝할 수 있다. 대규모 GPU 클러스터 환경 자체가 필요 없게 된 셈이다. 이에 기업들은 생성형 AI 앱을 전보다 편리하고 빠르게 구축·배포할 수 있다.

관련기사

- AI 시장 내 입지 '글쎄'…스노우플레이크, 호실적 달성에도 못 웃는 사연은2024.08.22

- 삼성전자·넥슨코리아도 쓴다…스노우플레이크 AI 데이터 클라우드 최신 기술 뭐길래?2024.08.21

- 제키, 스노우플레이크 마켓플레이스에서 데이터세트 출시2024.07.17

- 클라우드로 환자 데이터 공유…스노우플레이크의 목표는 '현재 진행형'2024.07.04

최 지사장은 "국내 상위 10대 기업 중 80%를 확보한 상태"라며 "사용하기 쉽고 효과적인 서비스를 제공한다는 가치를 지킬 것"이라고 말했다.