“최예진보다 인공지능(AI)을 더 잘 설명하는 사람은 거의 없다.”

빌 게이츠 마이크로소프트(MS) 창업자가 지난해 11월 최예진 워싱턴대 교수와 대담을 나눈 뒤 자신의 유튜브 계정에 영상을 올리며 이렇게 말했다. 미국 시애틀에 있는 워싱턴대의 컴퓨터과학 교수인 최 교수는 지난해 타임지가 선정한 ‘인공지능 100대 인물’ 중 한국인으로는 유일하게 뽑혔다.

옥스퍼드 대학교 AI윤리연구소 선임연구원이기도 한 그의 주요 연구 분야는 AI가 상식적인 지식과 추론을 학습할 수 있는 지, 또 기계가 도덕적 추론을 학습하는 것이 가능한 지에 관한 것이다. 특히 15분 강연으로 유명한 '세바시'에서 그가 생성AI를 일컫어 "놀랍도록 똑똑하고 충격적으로 어리석다"고 한 촌철살인 발언은 두고두고 회자되고 있다. 또 그의 '빨래 말리는시간 계산 프롬프터'도 유명하다. 생성AI 어리석음을 지적할때 자주 인용된다. 1999년 서울대를 졸업한 최 교수는 코넬대에서 박사 학위를 받았고 AI와 인간간 의사소통을 더 자연스럽게 하는 연구에 천착, 2022년 10월 '천재들의 상'이라 불리는 맥아더 펠로십에 선정되기도 했다.

■ 자연어처리 분야 세계적 권위자...

컴퓨터를 이용해 언어를 분석하는 NLP(자연어처리) 분야 세계적 권위자인 최 교수가 12일 서울 중구 대한상공회의소 국제회의장에서 열린 ‘한겨레 사람과디지털포럼’에서 온라인으로 미국 현지에서 기조연설을 했다. 평소 AI가 인간과 달리 상식이 없다고 지적해 온 그는 이 날도 생성AI의 약한점과 보완점을 소개하며 특히 질의응답시간에 세계적으로 논란인 범용인공지능(AGI) 도래 시기에 대한 본인 의견도 밝혔다.

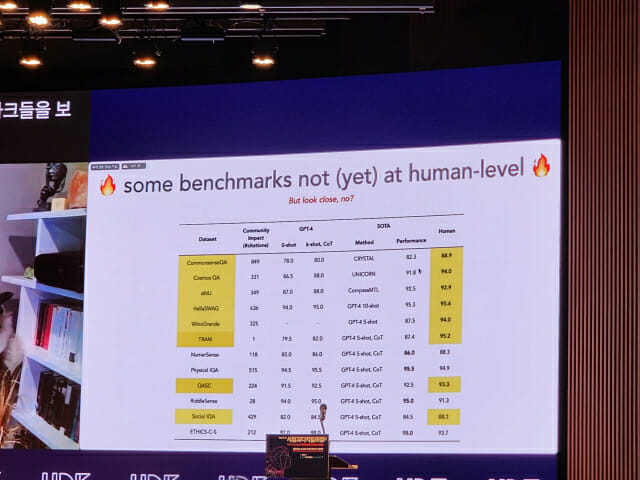

최 교수는 "우주는 암흑물질 95%와 보통물질 5%로 구성돼 있다"고 운을 떼며 강연을 시작했다. 인류가 아직 생성AI를 완전히 파악하지 못했지만 큰 영향을 주고 있다는 의미에서 든 예화였다. 또 심리학에 '마음이론(theory of mind)'이 있는데, 이는 마음과 행동이 어떤 관계가 있는 지를 연구하는 것으로, 최 교수는 마음이론에 나오는 예를 소개하며 생성AI가 동시에 지닌 똑똑함과 어리석음을 설명했다. 즉, GPT가 마음이론의 문제를 처음엔 못 풀지만 기능을 보완해 나중에 해결하지만 문제를 변형하면 다시 못 푼다. 이 예를 들며 최 교수는 "지피티4가 마음이론 챌린지에서 어려움을 겪었다"면서 "AI는 똑똑하지만 바보다라는 발표를 한 적이 있다"고 들려줬다.

최 교수가 AI에 입력한 문제인 '빨래 말리는 시간 계산' 문제도 AI의 어리석음을 말할때 대표적으로 거론된다. 즉, 챗GPT에게 '5개의 옷을 말리는 데 5시간 걸렸다. 그럼 30개 옷을 말리기 위해선 얼마나 걸리나?"고 물었더니 "30시간 걸릴 것"이라고 답했다는 것이다. 상식이 없는 AI가 기계적으로 계산한 답이다. 최 교수가 이 사례를 공개한 이후 오픈AI가 바른 답이 나오도록 챗GPT를 업데이트한 것으로 알려졌다. 이 사례를 들려주며 최 교수는 "흔히 챗GPT가 뛰어나다고 알려졌지만, 기본적이고 상식적인 질문에(인간과 달리) 정확한 대한 답을 주지 못한다"고 꼬집었다.

최 교수는 세계 AI 4대 천왕 중 한명이자 뉴욕대 교수이며 메타 수석과학자인 얀 르쿤이 한 말도 인용했다. 르쿤이 AI를 일컫어 "강아지만큼 똑똑하지 않다"고 했다는 것이다. 이어 최 교수는 "인간에게 상식은 쉽다. 하지만 기계는 어렵다"면서 "(생성AI가) 굉장히 많은 지식을 습득했음에도 실수를 많이 하는 이유"라고 해석했다.

■ "AI는 창조하지만 이해 못해...사람은 이해보다 생성이 어려워"

최 교수는 생성AI 역설도 짚었다. "AI는 창조는 하지만 이해는 못한다"면서 "하지만 사람은 이해보다 생성이 어렵다. 생성AI와 반대다. 이 부분이 중요하다"고 강조했다. 이의 실제 사례도 소개했다. AI에게 플랭크 운동하는 우주인을 그려보라고 하면 여러 이미지를 생성하는데 이해력이 없는 AI는 어느 게 정확한 플랭크 운동인지 알 수 없어 잘못된 그림도 생성한다면서 "AI는 행위에 대한 이해가 높지 않다"고 해석했다. GPT가 질문에 대부분 정확한 답을 하지만, 다양한 근거를 바탕으로 이해하는 건 부족하다는 것이다.

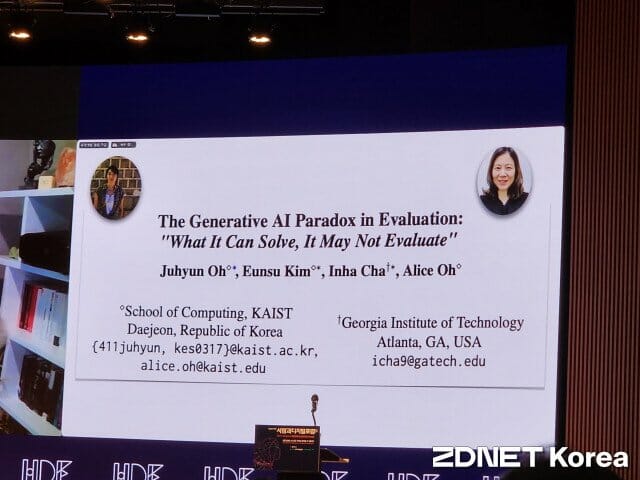

또 국내 KAIST 오혜연 교수와 같이 연구한 내용이라면서 "생성AI는 평가는 못한다"면서 "상식이 부족해 생성AI의 역설이 발생한다"고 말했다. 이어 최 교수는 '클립 최대화(Paperclip Maximizer)' 개념을 제시하며 "AI에게 수백만개 도덕적 규범을 다 가르칠 수 없다. 챗GPT가 대규모 학습을 한다고 해서 도덕적 규범을 안다고 생각하면 안된다"고 밝혔다.

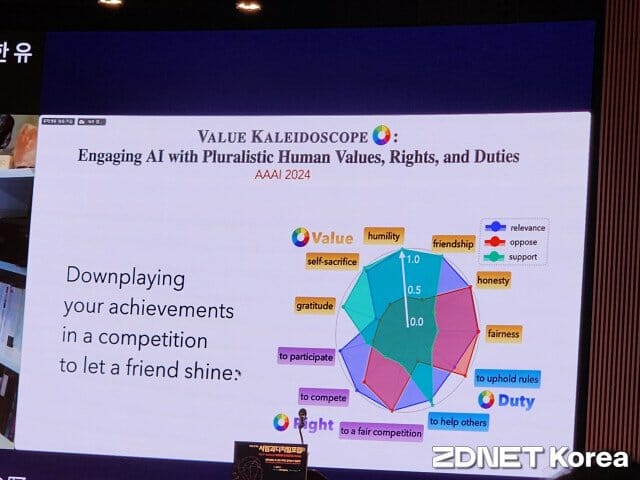

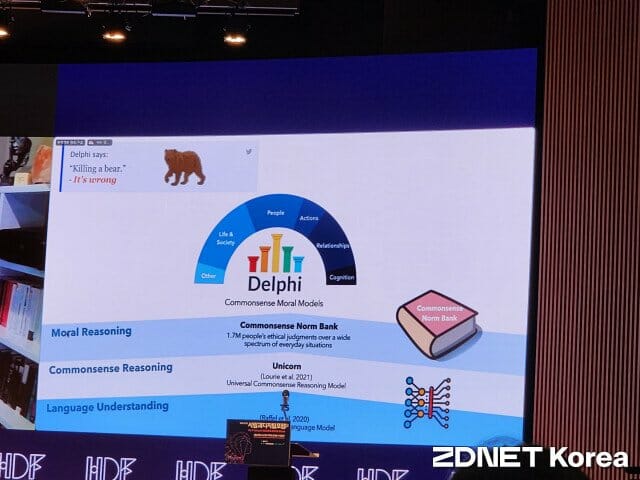

상식이 없는 AI를 보완하기 위해 최 교수는 상식을 추가한 델파이 모델(Commonsense Moral Mdels)을 만들었다면서 이번 행사에서 이를 공개했다. 특정 상황에 따라 가치가 달라지는 걸 가르치는 모델이라면서 "AI와 도덕, 철학이 합쳐진 학습데이터를 만들어야 한다"고 강조했다. 이와 관련한 것으로 '2024년 AAAI' 행사에서 발표한 논문(제목:Value Kaleidoscope: Engaging AI with Pluralistic Human Values, Rights, and Duties)도 소개했다.

최 교수는 "물리학 전문가들은 자기가 무얼 모르는지를 모르는 경우가 많다고 하더라"면서 AI연구에서 다원적 접근과 다원적 문화가 필요하다고 밝히며 그의 강연을 네가지로 요약했다.

첫째, 트랜스포머와 LLM을 과학의 한 방편으로 연구해야 하며 둘째, 역사적으로 첫 발견은 완벽한 솔루션이 아니니 더 좋은 대안 솔루션이 나올 것으로 생각, 더 많은 연구와 투자를 해야 하고 셋째, 인텔리전스(intelligence)와 artificial을 측정하는데 본원적인 애매함이 있음을 받아들여야 하며 넷째, AGI(범용AI) 같은 큰 변화가 오고 있다는 것이다.

기조강연에 이어 최 교수는 하정우 네이버 퓨처 AI센터장과 온라인으로 질의응답을 하며 AGI와 생성AI에 대한 자신의 생각을 보다 자세히 밝혔다. 하 센터장이 "최 교수님이 생각하는 AGI는 무엇이며, 또 언제 달성할 것으로 보냐"고 묻자 최 교수는 "휴먼 인텔리전스(Human Intelligence)도 정의(디파인)를 못하는데 AGI를 어떻게 정의 하겠냐"고 전제하며 "이르면 3년안에 이걸 AGI라고 하는 사람들이 30% 정도 되지 않을까 한다. 또 2050년까지는 이 비중이 50%가 될 것으로 본다. 나는 길게 본다. 넘어야 할 산이 아주 많다'고 답했다. 이어 "실제로는 안되지 않을까도 한다"면서 "하지만 절대로 안된다고 또 된다고 말할 수 없다. 변수가 너무 많다. 어느 나라나 연구소에서 색다른 AI를 창출하면 도달할 가능성이 커지는 등 변수가 많아 정확한 예측이 어렵다"고 덧붙였다.

현 AI의 문제를 해결할 아이디어가 있냐는 하 센터장의 두번째 질문에 최 교수는 현재 LLM은 주입식 교육과 벼락치기식으로 하고 있다면서 "사람은 되돌아가서 질문을 다시 점검하고 탐색하고 생각도 한다. 하지만 AI는 이런 걸 못한다. 순차적으로 계속해야 한다. 안좋은 게 들어와도 그걸 공부해야 한다"면서 "에이전트 개념을 트레이닝(학습)할때도 주입식이 아닌 방식으로 해야 한다"고 말했다.

■ "공돌이로서 처음엔 관심 없어...미리 준비 안하면 후회할 상황 오겠다 싶어 연구"

이어 AI가 혁신을 가지고 오는 것도 사실인데, 주의해야 할 것 두 가지만 들려달라고 하자 최 교수는 생성AI 모델들이 가상현실과 현실을 명확히 구분 못하고, 또 사실과 거짓을 혼동하는 이유는 궁극적으로 지식(날리지)과 팩트를 명확히 공부 못한, 희미하게 대충 공부한 탓이라면서 "이는 멀티모달이든 뭐든 공통 챌린지다. 패치업(보완) 할 수 있는 방안이 필요하며, 또 중장기적으로는 다른 방안이 있어야 할 듯하다. 체계적으로 공부할 수 있는 모델이 개발돼야 하지 않을까 한다. 또 하나는, 인간의 가치와 상식, 이런 것들을 처음부터 잘 가르쳐야 한다. 다행히 학계에서 이런 쪽으로 관심이 모아지고 있다"면서 "사실 나도 공돌이로서 처음엔 별로 관심이 없었다. 미리 준비하지 않으면 후회할 상황이 오겠다 싶어 연구를 하게됐다"고 말했다.

AI의 안전에 대해 현 시점에서 해결해야 할 문제를 짚어달라는 하 센터장 요청에 최 교수는 "나도 참여하면서 배우고 있다. 정치 싸움도 많이 있는데 아쉽다. 어떤 사람은 본인 이윤에 따라 의견을 낸다. 또 어떤 사람은 전혀 관심 없으며 그래봤자 언어모델이며 안전이 중요하다고 하는 건 바보짓이라고 하는 사람도 있다. 이 모든 것들이 어쩔 수 없는 상황이다. 그만큼 우리가 (AI)를 잘 몰라서 그렇다. 깊은 연구가 돼 있으면 불일치가 없을텐데, 워낙 우리가 모르는게 많다보니 그렇다"면서 "그럴수록 안하기보다 이거 기회구나 하는 마음으로, 인류에 필요한 연구를 하는, 좋은 기화로 보고 투자를 더 해야 한다. 안전을 절대적으로 확신할 수 없으니 정치색을 떠나 더 많은 연구를 해야한다"고 밝혔다.

특히 최 교수는 기존 AI관련 학회와 별도로 최근 언어(랭귀지)에 특화한 COML이란 자연어처리 전문 학회를 새로 만들었는데, 이의 이유를 묻자 "기존 언어학회인 뉴립스(NewrlPS) 등이 너무 커서"라고 답했다. COLM은 언어 모델링 연구에 중점을 둔 학회로 LM 기술 개발을 이해하고 개선 및 비판하는 데 중점을 두고 있다. 오는 10월 7~9일 3일간 미국 필라델피아대학에서 컨퍼런스를 개최한다.

관련기사

- [기고] 여러분의 조직은 생성AI를 도입할 준비가 됐습니까2024.06.11

- "생성AI, 발전 무궁무진···통합 플랫폼 갖춰 추진해야"2024.05.23

- 배달앱 수수료 7.8%로 인하...'배민 상생안' 극적 합의2024.11.14

- 경계 사라진 비즈니스...엔비디아·어도비 등 ‘빅테크 혁신 팁’ 푼다2024.11.14

AI 맹점 중 하나가 결론을 낸 것에 대해 왜 이런 결론을 냈는지 설명을 못하는 소위 '블랙박스' 문제다. 최근 미국 AI스타트업 엔스로픽이 이를 해결할 단초가 되는 기술을 개발했다고 밝혔는데 이에 대해 교수는 "좋은 연구 방향이라고 생각한다"면서 "완벽한 툴이 될 가능성은 없지만 큰 도움이 될 수 있는 디렉션(방향)이다. 데이터 말고도 인프라 알고리즘 쪽으로도 연구를 할 수 있다고 본다"고 말했다.

하 센터장이 마지막 질문으로 AI 꿈나무들에게 한마디 해달라고 하자 최 교수는 "솔직히 나도 공부할때 여기까지 올 거라고 생각 못했다. (나를 아는) 다른 분들도 그랬을 거다. 뒤집어 보면, 누구나 가능성이 있다는 거다. 노력을 꾸준히 하는 게 중요하다"면서 "돌이켜보면 용기를 내 도전을 한 게 중요하지 않았나한다. 나는 다른 사람들이 가는 길 보다도, 나만의 길을, 이 길이 성공의 길이 아니더라도, 다른 사람에 끼여 가는게 아니라 블라인드 스팟을, 내가 대신 연구해주면, 실패하더라도 누군가에게 도움이, 배움이 되지 않을까 했다. 마음을 비우고 가는게 중요하다. 성공해야지 보다 의미있는 삶을 살아야지 하는 마음으로, 실패를 하더라도 나는 도전을 했다, 용기를 갖고 도전해보라고 말하고 싶다" 밝혔다.