구글이 언어모델을 이용해 음성 등 자연어로 로봇의 행동을 제어할 수 있는 인공지능(AI)을 공개했다.

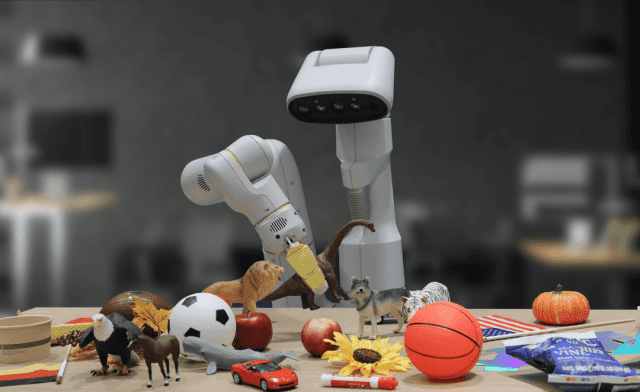

실리콘앵글 등 외신에 따르면 구글이 새로운 로봇용 AI 로보틱 트랜스포머2(RT-2)를 공식 블로그를 통해 공개했다.

RT-2는 시각적 언어행동 모델(VLA)이라는 새로운 시스템을 적용했다. 시각언어모델(VLM)인 'PaLM-E'와 트랜스포머 기반 언어모델을 결합해 이미지를 인식하거나 단어를 들으면 별도로 학습하지 않아도 동작에 바로 적용할 수 있는 것이 특징이다.

이를 통해 음성이나 자연어 입력 등 간단한 방식으로 로봇의 행동을 자연스럽게 제어하는 것이 가능하다.

빈세트 반후케 딥마인드 로봇공학 책임자는 “이전에는 로봇이 쓰레기를 버릴 수 있게 하려면 쓰레기를 식별하고 주워서 버릴 수 있도록 명시적으로 교육해야 했다”며 반면, RT-2는 웹 데이터를 통해 학습한 지식으로 쓰레기가 무엇인지 알고 있고, 청소하는 방법에 대한 아이디어까지 가지고 있다”고 설명했다.

이어서 “쓰레기는 과자 봉지나 바나나 껍질 등 상당히 추상적이라 이를 모두 학습시키기 어려운 면이 있지만, RT-2는 비전 언어 교육 데이터에서 이를 이해하고 작업을 수행할 수 있다”고 말했다.

또한 구글은 VLA 사용하는 과정에서 필요한 데이터만 사용해 속도저하 등의 악영향이 발생하지 않도록 개선작업을 거쳤다.

관련기사

- "구글·애플, 폴더블 태블릿 출시 검토 중"2023.07.27

- 구글·MS, 나란히 호실적에 주가는 왜 반대로?2023.07.27

- 美 법률 생성 AI 몰려온다…국내시장 위협2023.07.28

- 이미지생성 AI '스테이블디퓨전XL 1.0' 출시2023.07.27

“챗봇과 달리 로봇은 인식한 사물에 대한 모든 데이터를 아는 것이 오히려 역효과를 불러온다”며 “예를 들어 사과를 인식한다면 사과의 역사, 아이작 뉴턴 등이 필요한 것이 아니라 빨간 공과 구별하고 어떻게 안전하게 집을 것인지 빠르게 처리하는 것이 중요해 데이터를 제한할 필요가 있다”고 설명했다.

이어서 "RT-2는 AI의 발전이 어떻게 로봇 공학으로 연결되는지 보여줄 뿐만 아니라 범용 로봇에 대한 가능성을 보여준다"며 "인간 중심의 환경에서 실질적인 로봇이 구현되기 위해선 아직 많은 작업이 남아았지만 RT-2는 흥미로운 미래의 일부를 제시한다"고 말했다.