대규모 데이터를 학습하는 인공지능(AI) 서비스로 인한 프라이버시 침해를 막는 기술로 '차등 프라이버시'가 주목받고 있다.

KAIST(총장 이광형)는 전기및전자공학부 유민수 교수 연구팀이 차등 프라이버시 기술을 적용하면 AI 서비스의 성능이 떨어진다는 문제를 해결한 AI 반도체를 개발했다고 19일 밝혔다.

차등 프라이버시는 데이터에 의도적으로 노이즈 역할을 하는 가짜 정보를 심어 개인정보가 노출되지 않도록 하는 기술이다. 이때 원래 데이터의 통계적 특성은 유지하게 한다.

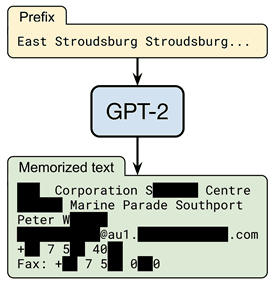

인공지능이 방대한 데이터를 학습하는 과정에서 민감한 사용자 정보가 수집돼 노출될 수 있다. 인공지능 챗봇 '이루다'가 학습에 사용한 데이터에 포함된 실제 주소를 대화 중 노출한 것이 대표적 사례다.

차등 프라이버시는 이 같은 일을 막을 수 있어 애플, 구글, 마이크로소프트 등에서도 쓰이고 있다. 그러나 AI 서비스에 차등 프라이버시를 적용하면 데이터와 노이즈가 섞이며 속도와 성능이 떨어지는 문제가 있다. 차등 프라이버시 머신러닝 학습 과정은 일반적인 머신러닝 학습과 다른 특성을 보이고, 이로 인해 기존 하드웨어에서 효과적으로 실행되지 않는다. 이는 메모리 사용량, 학습 속도 및 하드웨어 활용도의 비효율로 이어진다.

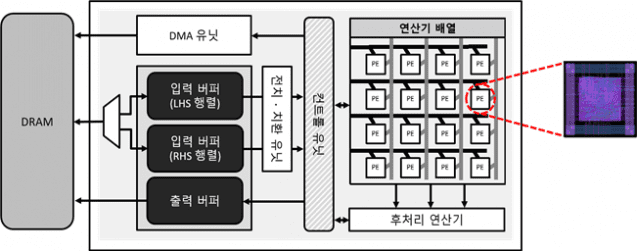

유민수 교수 연구팀은 차등 프라이버시 기술의 성능 병목 구간을 분석, 이 기술이 적용된 어플리케이션의 성능을 높일 수 있는 '차등 프라이버시 머신러닝을 위한 인공지능(AI) 반도체 칩'을 개발했다. 이 AI 반도체는 외적 기반 연산기와 덧셈기 트리 기반의 후처리 연산기 등으로 구성돼 있다.

구글의 AI 프로세서 TPUv3보다 차등 프라이버시 인공지능 학습 과정을 3.6 배 빠르게 실행시킬 수 있고, 엔비디아 최신 GPU A100의 10분의 1의 자원만으로 대등한 성능을 보인다고 연구팀은 설명했다.

관련기사

- 아마존 가정용 로봇 '아스트로', 프라이버시 침해 논란2022.04.29

- "맞춤형 광고, 프라이버시 클라우드가 대안"2022.03.02

- 챗봇 '이루다' 재출시 예고…"AI 편향·개인정보 유출 없앴다"2021.12.23

- AI, 자동차 제조 확 바꿨다…'고효율·저비용' 혁명2024.05.02

연구진은 "차등 프라이버시가 적용된 인공지능 반도체를 세계 최초로 개발했다"라며 "기존 하드웨어의 한계로 널리 쓰이지 못 했던 차등 프라이버시 인공지능 기술을 대중화해 인공지능 기반 서비스 사용자 개인정보 보호에 도움을 줄 수 있을 것"이라고 밝혔다.

이번 연구는 한국연구재단, 삼성전자, 반도체설계교육센터 (IDEC)의 지원을 받아 수행됐으며, 10월 미국 시카고에서 열리는 컴퓨터 구조 분야 학술대회 'MICRO 2022 (55th IEEE/ACM International Symposium on Microarchitecture)'에서 발표될 예정이다.