올해 1분기 페이스북과 인스타그램서 발생한 혐오발언 콘텐츠가 3천만 건이 넘은 것으로 나타났다.

페이스북은 최근 올해 1분기 커뮤니티 규정 집행 보고서를 내고 10가지 항목에 대한 페이스북의 조치에 대해 알렸다.

먼저 페이스북과 인스타그램은 1분기에 각 2천520만 건, 630만 건의 혐오 발언 콘텐츠에 삭제나 차단 등의 조치를 했다. 조직적인 혐오 콘텐츠의 경우, 페이스북은 지난해 4분기 640만 건에서 증가한 980만 건에 대해 조치를 했고, 인스타그램도 역시 지난해 4분기보다 향상된 수치인 32만4천500 건에 대해 조치했다.

또한 페이스북은 1분기에 880만 건의 따돌림 및 괴롭힘 콘텐츠에 조치를 했고, 이는 지난해 4분기 630만 건에 비해 크게 증가한 수치다. 인스타그램의 경우, 지난해 4분기 500만 건에서 올해 1분기에는 550만 건으로 증가했다.

아울러 올해 4월까지, 코로나19 관련 공중 보건에 해가될 수 있는 잘못된 정보를 확산시키는 등 페이스북의 정책을 위반한 콘텐츠 1천800만 건 이상이 페이스북과 인스타그램에서 삭제됐다.

이번 보고서에는 인스타그램 내 성인 나체 이미지 및 성적 행위, 폭력적이고 자극적인 콘텐츠에 대한 확산율을 첫 공개했다.

올해 1분기, 페이스북과 인스타그램 모두에서 성인 나체 관련 콘텐츠의 확산율은 0.03-0.04%에 그쳤다. 페이스북 내 폭력적이고 자극적인 콘텐츠 확산율은 0.03-0.04%로 2020년 4분기 0.05%에서 하락했다. 인스타그램의 경우, 1분기 폭력적이고 자극적인 콘텐츠 확산율은 0.01-0.02%로 나타났다.

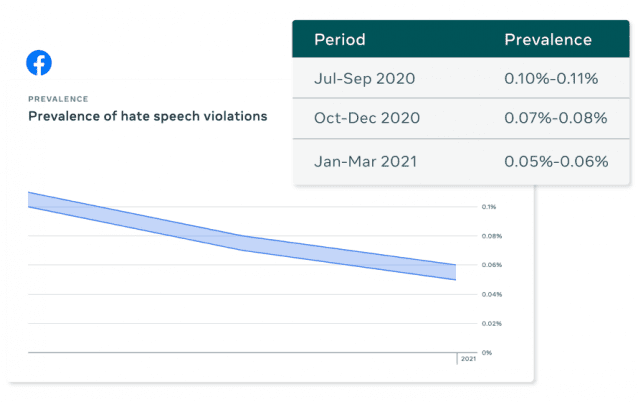

페이스북 내 혐오 발언 콘텐츠 확산율이 지속 감소하고 있다는 것도 발견됐다. 올해 1분기에는 0.05-0.06%로, 이는 조회수 1만 회당 혐오 발언 콘텐츠는 5~6건에 불과했음을 뜻한다.

사전 조치율은 누군가가 신고하기 전에 페이스북의 시스템이 먼저 발견한 위반 콘텐츠의 비율을 의미하는데, 페이스북은 그동안 AI 기술의 발전으로 사전조치율을 높여왔다.

관련기사

- 페이스북, 유럽→미국 데이터전송 조사받는다2021.05.20

- 페이스북, 인공지능에 망각 도입한다2021.05.17

- 獨 정부, 페이스북에 왓츠앱 개인 데이터 처리 금지2021.05.12

- 페이스북 우려 현실화…4%만 앱추적에 동의2021.05.08

혐오 발언 콘텐츠의 경우, 처음 수치를 공개했던 2017년 4분기에는 23.6%를 사전에 탐지할 수 있었던 것에 비해, 현재는 약 97%를 이용자 신고 이전에 미리 탐지하고 있다.

페이스북 측은 "지난해 8월, 커뮤니티 규정 집행 보고서의 수치가 올바르게 측정되는지 검증하기 위해 독립적인 감사 진행에 대해 발표한 바 있다"며 "해당 감사는 회계 법인 EY가 담당하게 됐다"고 밝혔다.