인텔 내부의 선행 기술 연구 조직인 인텔 랩스가 3일(미국 현지시간) 딥러닝 학습 과정의 데이터 유출 등을 방지할 수 있는 개념인 '기밀 컴퓨팅'(Confidential Computing)을 소개했다.

이날 제이슨 마틴 인텔 랩스 수석 엔지니어는 "기밀 컴퓨팅은 의료나 금융 등 민감한 데이터를 다른 곳으로 전송하지 않아도 AI의 정확도를 높일 수 있고 이를 통해 데이터가 고립되는 현상인 '데이터 사일로'를 최소한으로 줄일 수 있을 것"이라고 밝혔다.

■ 민감한 데이터 고립되는 '데이터 사일로' 현상

AI는 의료 영상이나 금융 분야에서 많은 성과를 거두고 있다. 그러나 보다 좋은 결과를 얻으려면 많은 데이터를 이용한 딥러닝이 필수적이다.

제이슨 마틴은 "머신러닝의 정확도는 데이터에 좌우되지만 이런 훈련은 중앙 집중적으로 데이터를 처리할 필요가 있다. 그러나 프라이버시 등 문제가 되는 데이터를 함부로 내보낼 수 없다"고 지적했다.

따라서 개인 정보나 기업 비밀과 관련된 데이터를 함부로 다른 곳으로 전송할 수 없어 이를 기업이나 병원 등에서 고립된 채로 저장해 두는 '데이터 사일로' 현상이 나타난다.

■ 머신러닝 모델만 모아서 훈련하는 '연합 학습'

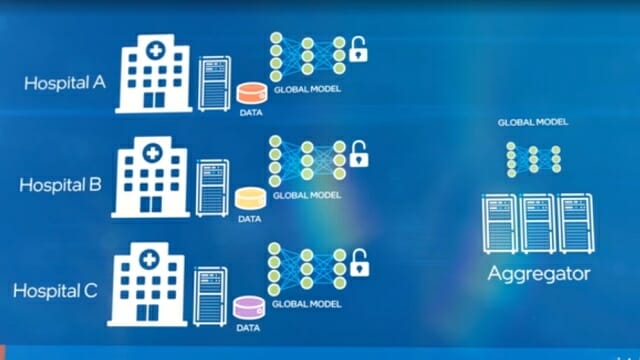

이날 인텔 랩스가 소개한 새로운 모델인 '연합 학습'은 민감한 데이터를 내보내는 대신 이를 다루는 머신러닝 모델만 모아서 훈련하는 방식이다. 서로 다른 곳에서 개발한 머신러닝 모델을 한 서버에 모아서 서로가 가진 장점을 학습하고 다시 되돌아간다.

이는 서로 다른 기업의 직원들이 한 곳에 모여 새로운 지식이나 기술에 대해 토론하며 연수를 하는 방법과 유사하다. 이 방법을 활용하면 민감한 데이터를 다른 곳으로 내보내야 한다는 부담은 덜면서 머신러닝 모델의 정확도는 높일 수 있다.

연합 학습에는 인텔이 내년 출시할 3세대 제온 스케일러블 프로세서에 내장된 SGX(소프트웨어 가드 익스텐션) 기술도 동원된다. 이 기술은 서버에서 처리하는 프로그램과 데이터를 격리하고 암호화 해 데이터가 실행되는 과정을 엿볼 수 없게 보호한다.

제이슨 마틴은 "미국 펜실베이니아 대학과 MRI 영상에서 뇌종양을 감지하는 머신러닝 모델을 훈련한 결과를 비교한 결과 기존 데이터 집중식 학습에 비해 정확도가 크게 떨어지지 않았다"고 설명했다.

■ "동형 암호화 처리 위한 맞춤형 하드웨어 개발중"

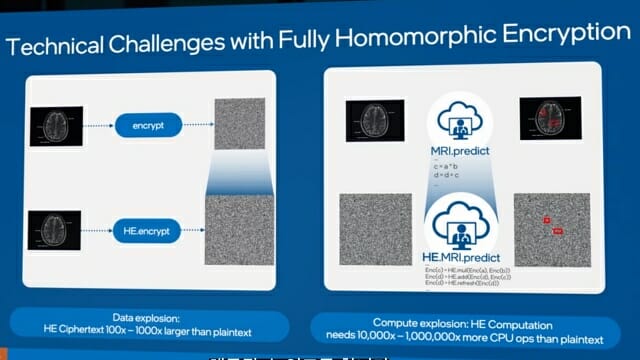

서버 사이에 민감한 데이터를 주고 받으려면 데이터 암호화는 물론 이를 해독할 수 있는 키 교환이 필수적이다. 그러나 키를 주고 받는 과정에서 암호화 키가 유출되면 암호화된 데이터가 유출될 우려가 있다.

2009년 등장한 동형 암호화(Homomorphic Encryption) 기술은 데이터를 암호화된 상태 그대로 전달 받아 계산해도 암호화되지 않은 데이터와 동일한 결과를 얻을 수 있다. 이를 통해 민감한 데이터 노출 없이 데이터 공유와 협업이 가능하다.

관련기사

- "머신 프로그래밍, 인간 뛰어넘는 잠재력 가졌다"2020.12.04

- 인텔 랩스, 5대 차세대 기술 공개2020.12.04

- MS, TPM 대체할 보안칩 '플루톤' 공개2020.11.19

- 인텔-MS, 동형암호 쓰는 AI용 프라이버시 표준 만든다2019.08.19

로사리오 카마로타 인텔 랩스 수석 엔지니어는 "동형 암호화 기술을 데이터에 적용할 경우 기존 전통적인 암호화에 비해 처리 시간은 물론 복잡도도 늘어난다. 또 이를 처리할 수 있는 기술 표준화도 이뤄지지 않은 상황"이라고 설명했다.

이어 "인텔은 학계는 물론 동형 암호화 커뮤니티와 협력해 표준화에 기여하는 한편 이를 처리할 수 있는 맞춤형 하드웨어도 개발중"이라고 덧붙였다.