퓨어스토리지가 기업용 스토리지와 협력사의 주특기를 결합한 고성능컴퓨팅(HPC) 시스템 구축 솔루션으로 기업용 인공지능(AI) 인프라 시장을 정조준했다. AI의 재료인 데이터를 더 빠르게 처리하고 분석할 수 있게 돕는 수단으로 '하이퍼스케일 에이리(Hyperscale AIRI)'를 선보이면서다.

퓨어스토리지는 비즈니스 혁신을 위해 폭증하는 데이터를 보다 빠르게 처리하고 분석하는 방안을 시도하는 기업들이 많아지고 있다고 지적했다. 이에 하이퍼스케일 에이리처럼 기업들의 모든 AI 요구사항을 충족시키는 통합 인프라 및 스토리지를 통해 리더십을 강화하고 있다고 자부하고 있다.

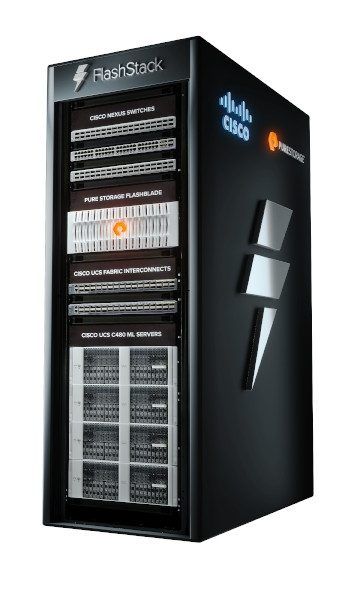

지난 3월 등장한 하이퍼스케일 에이리는 AI 및 딥러닝 학습을 가속할 수 있는 엔비디아 DGX서버, 퓨어스토리지 플래시블레이드 스토리지시스템, 엔비디아에 인수되는 멜라녹스의 HPC 클러스터 네트워크 기술을 탑재한 통합시스템이다. 이 통합시스템은 랙 64대까지 확장해 빠른 속도로 데이터를 비즈니스 가치로 전환할 수 있다는 게 퓨어스토리지의 설명이다.

퓨어스토리지는 기업의 AI 인프라가 간단한 확장 및 무중단 업그레이드를 통해 딥러닝 및 GPU의 원활한 구동에 필요한 다양한 데이터를 지속적으로 제공하며 데이터 수집, 변환, 학습, 검증을 거치는 AI 데이터 파이프라인 가속화를 지원하는 고성능을 갖춰야 한다고 봤다. 그런데 플래시와 컨트롤러를 직렬 연결하는 기존 인프라로는 병목현상과 복잡한 확장 프로세스로 이 요건을 충족하기 어렵다고 지적했다.

퓨어스토리지는 하이퍼스케일 에이리가 단순한 아키텍처에서 방대한 병렬 처리를 지원하는 플래시블레이드 스토리지 시스템을 기반으로 HPC의 슈퍼컴퓨팅 성능을 제공해 데이터 병목현상을 제거한다고 주장했다. 서버 프로비저닝 및 블레이드 추가로 연산 증가에 따라 서버 및 스토리지 시스템을 확장시키며, 500페타플롭스 이상의 딥러닝 연산 성능을 구현했다고 설명했다. 사용자 친화적 API, 컨테이너형 AI 프레임워크, 멀티서버 기반 모델 학습, 쿠버네티스 통합 지원을 통해 규모에 관계없이 AI 작업 전체의 생산성을 높인다고 강조했다.

퓨어스토리지는 또 플래시블레이드가 방대한 병렬 아키텍처를 기반으로 설계돼 수 페타바이트 용량의 규모로 스케일아웃 확장을 할 수 있고 레거시 시스템의 스케일업 기반 IO 처리 대비 병목현상을 줄여, 고성능과 간소화 효과를 줄 수 있다고 밝혔다. 여러 DGX서버에 데이터를 공급해 서버 활용도를 높이고, 레거시 인프라의 '사일로'를 통합하고, 비정형 데이터를 포함한 모든 데이터를 빠르게 처리해 AI 인프라의 데이터 허브 역할을 수행할 수 있다고 덧붙였다. 이는 데이터과학자가 데이터 및 AI 업무에 더 집중할 수 있게 해준다는 설명이다.

하이퍼스케일 에이리는 먼저 출시된 에이리의 HPC 시스템용 업그레이드 버전이다. 퓨어스토리지에 따르면 에이리는 지난 2018년 3월 출시 이후 헬스케어, 금융서비스, 자동차, 테크, 고등교육 및 연구 등 전세계 다양한 산업에서 널리 구축되며 기업들의 AI 및 딥러닝 기반 혁신을 도왔다. 일례로 딥러닝 기반 자율주행기술업체 제누이티(Zenuity)는 대규모 데이터 처리 및 모델 반복 학습 플랫폼을 구축해 안전한 자율주행을 보장하는 소프트웨어를 개발하고, 이를 위한 모델 학습 시간을 단축했다.

관련기사

- 퓨어스토리지, 파일 솔루션 기업 '컴퓨버드' 인수2019.07.18

- 퓨어스토리지, 1TB 4분만에 복구하는 데이터 보호 솔루션 출시2019.07.18

- 퓨어스토리지, 매튜 우스티븐 아태지역 CTO 선임2019.07.18

- 퓨어스토리지, 나라장터에 올플래시 스토리지 3종 등록2019.07.18

퓨어스토리지는 앞으로도 간단하고 손쉬운 AI 솔루션으로 기업이 AI 인프라를 신속하게 도입하고 무제한 확장시켜 AI 데이터파이프라인을 무중단 가속하도록 지원할 계획이라고 밝혔다.

배성호 퓨어스토리지코리아 대표는 "많은 기업이 AI 인프라를 활용하거나 도입을 적극적으로 검토하고 있다"며 "퓨어스토리지는 앞으로도 최고의 학습 성능을 제공하며 생산성을 극대화한 AI 인프라 솔루션을 통해 기업들이 확신을 갖고 AI 인프라를 구축해 애플리케이션을 개발하도록 지원할 것"이라고 말했다.