사람의 동작을 보고 배우는 인공지능(AI) 로봇이 나올 전망이다.

미리 입력된 알고리듬 값에 기계적으로 움직일 수 있는 범위 내에서 작동하는 것이 아니라 사람의 몸짓을 시각적으로 이해하고 이를 따라할 수 있는 수준의 AI 연구가 진행되고 있어서다.

21일(현지시간) 미국 지디넷닷컴에 따르면 엔비디아는 호주 브리즈번에서 열릴 예정인 컨퍼런스에서 이같은 내용이 담긴 논문을 발표할 예정이다.

로봇이 사람의 몸짓을 보고 따라하는 학습 과정을 통해 인간과 로봇의 커뮤니케이션은 물론 협동도 가능할 것이라는 게 논문의 주요 내용이다.

논문 저자는 해당 로봇의 신경망 회로로 엔비디아의 타이탄 X GPU가 쓰였다고 설명했다.

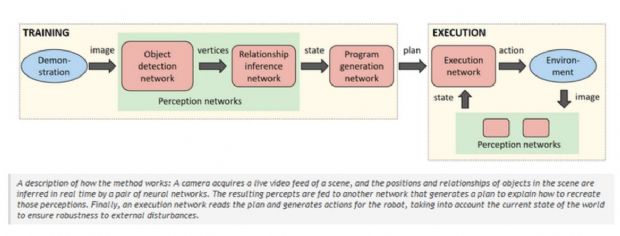

로봇은 카메라와 같은 시각 정보를 받아들인 뒤 사람과 같은 객체의 움직임을 시나리오에 따라 분석하게 된다.

관련기사

- MS, 음성 관련 AI 서비스 통합2018.05.22

- 美·中·日·佛·핀란드 AI 선도국 정책 분석2018.05.22

- 알리바바, 'AI 조명'으로 스마트홈 켠다2018.05.22

- AI 인공신경망 구조 임의 설계 가능해진다2018.05.22

이후 신경망 회로를 통해 어떤 방식으로 해당 동작을 따라할지 분석하고, 로봇 동체가 최대한 비슷한 움직임을 따라하는 식이다.

엔비디아는 로봇이 시각 정보 중심의 접근을 통해 인공적 데이터를 만들어내는 첫 사례라고 소개했다.