컴퓨터에게 사진 속의 사람과 동물들을 구별하도록 가르칠 수 있는 기술을 페이스북이 오픈소스 소프트웨어(SW)로 내놨다. 1년반쯤 전 공개했던 오픈소스프로젝트 '토치(Torch)'용 딥러닝 기술 개발의 후속조치다. 다음 목표는 사진을 넘어 영상(video)을 인식하는 거라고 한다.

미국 지디넷은 지난 25일 페이스북인공지능연구소(FAIR)가 '머신비전(machine vision)' 기술을 위해 만들어 온 기술의 오픈소스SW 코드와 툴을 더 많이 공개했다고 보도했다. 머신비전은 기계학습을 통해 이미지를 인식하는 기술을 가리키는 용어다.

[☞참조링크: Facebook open sources more machine vision, AI code]

[☞관련기사: 페이스북, 딥러닝 기술 오픈소스로 공개…속도↑]

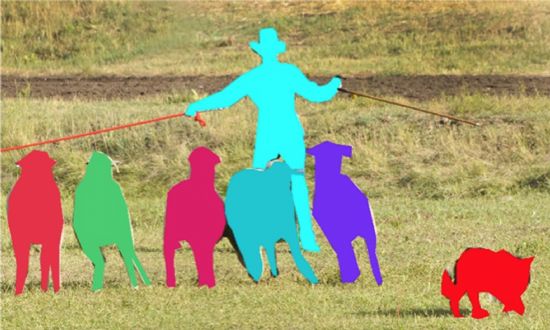

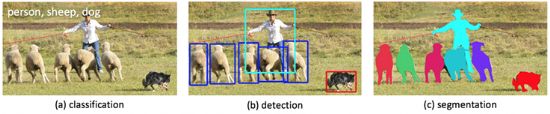

보도에 따르면 FAIR 연구팀은 머신비전과 안면인식 기술에 관한 자신들의 코드, 프레임워크, 연구결과를 오픈소스로 풀었다. 이들이 공개했다고 설명한 툴은 다음 3가지 구성요소를 포함한다. 이미지의 인식 영역을 구획으로 나누는 프레임워크 '딥마스크(DeepMask)'와, 딥마스크와 결합해 그 물체를 탐지하는 '샤프마스크(SharpMask)'와, 이미지의 각 물체를 분류하고 명칭을 붙여 주는 '멀티패스넷(MultiPathNet)'이다.

페이스북에게 사람들이 서비스에 시각적인 콘텐츠를 올리고 이용하도록 유도하는 게 중요한 목적이다보니, 이 회사에게 이미지인식에 관련된 기술은 대단히 핵심적인 요소다. 페이스북은 향후 사람들이 태그를 붙이거나 설명(caption)을 달지 않더라도 이미지를 검색할 수 있도록 만들고 싶어 한다.

머신비전은 그간 사람의 눈을 따라잡지 못했으나, 최근 연구는 그 격차를 좁혔다. 뉴요커 보도에 소개된 영국 런던의 '슈퍼리코그나이저'처럼, 범죄 용의자를 추적하기 위해 100만대에 달하는 런던의 CCTV 카메라에 찍힌 흐릿한 영상을 활용할 수 있는 시대다. 페이스북의 이미지는 일반적인 CCTV 영상보다 훨씬 화질이 낫기 때문에 컴퓨터가 알아차리기도 더 쉽다고 할 수 있다.

페이스북이 공개한 오픈소스 툴 가운데 딥마스크와 샤프마스크 알고리즘을 주목할 만하다. 페이스북은 그 코드와, 연구 논문과, 기술을 시연한 자료 등을 공개했다.

딥마스크는 사진을 픽셀단위로 분해한 다음 그 특성에 기반한 사물을 학습하는 알고리즘이다. 페이스북의 뉴럴네트워크는 이런 식으로 수백만건의 사례를 학습했다. 딥마스크는 기본적으로 바이너리 분류를 위해 이미지를 분해한다. 그럼 샤프마스크는 그 결과물을 정제한다.

페이스북의 관련 설명을 일부 인용했다. [☞참조링크: Learning to Segment]

관련기사

- "마인크래프트로 AI 연구"…MS 오픈소스 프로젝트 공개2016.08.28

- 구글, 스마트폰으로 사물인식률 높인다2016.08.28

- 야후, 플리커에 쓰는 딥러닝SW 공개2016.08.28

- 발전하는 딥러닝...이미지 보며 컴퓨터와 대화까지2016.08.28

"딥마스크가 피드에서 네트워크를 통해 앞으로 지나간 투박한 마스크를 추정하면, 샤프마스크는 딥 네트워크 안에서 그 정보의 흐름을 뒤집은 다음 딥마스크가 네트워크에서 선행된 먼젓번 레이어(처리)의 기능을 사용해 만든 추정을 정제한다. 이렇게 생각해볼 수 있다: 일반적인 물체의 윤곽을 포착하기 위해, 여러분은 당신이 보고 있는 게 뭔지를 고수준에서 이해해야 하는데(딥마스크), 하지만 여러분은 그 경계를 정확하게 잡기 위해 픽셀 단위까지 내려가는 저수준으로 되짚어야 할 필요도 있다(샤프마스크). 본질적으로, 우리는 네트워크의 모든 계층으로부터 얻은 정보를 사용하면서 추가적인 오버헤드(처리부담)를 최소화하는 게 목표다."

다음은 뭘까? 페이스북은 자신들의 인공지능을, 움직임이 더해져 한층 처리하기 까다로운 비디오를 인식하는 데 사용하길 원한다.