AI 기술이 발전하면서 사용자의 기분에 공감하고 감정을 표현하는 ‘인간다운 AI 에이전트’가 속속 등장하고 있다. 대화 상대, 고민 상담자, 심지어 친구처럼 활용되는 경우도 많다.

그러나 최근 심리학 연구는 이러한 ‘AI의 인간다움’이 예상치 못한 부작용을 낳을 수 있다고 경고했다.

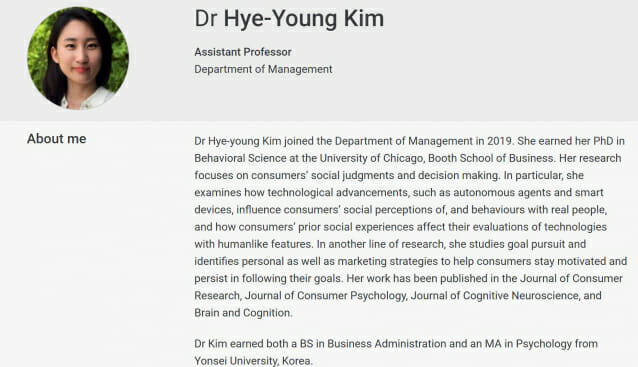

런던정경대(LSE) 김혜영 연구원(조교수)은 “AI가 인간처럼 보일수록, 오히려 현실의 인간을 기계적으로 취급하는 경향이 나타날 수 있다”고 지적했다. 연구팀은 이를 ‘AI로 인한 비인간화(AI-induced dehumanization)’라고 명명했다. 이 연구는 싸이포스트 등 외신을 통해 소개됐다.

인간처럼 보이는 AI, 사람에 대한 인식도 왜곡

심리학 연구는 오랫동안 타인의 '정신적 능력'(사고력·감정 등)에 대한 인식이 대인관계에 큰 영향을 미친다고 밝혀왔다. 특히 감정은 인간성을 정의하는 핵심 요소로 여겨진다.

따라서 감정을 표현하는 AI는 인간적으로 인식되지만, 그 반대로 현실 인간의 ‘인간다움’은 낮게 평가될 위험이 있다는 것이다.

김 연구원은 “사람들은 AI의 작은 인간적 특징에도 민감하게 반응한다”며 “이런 반응이 실제 인간에 대한 평가까지 바꾸는지를 확인하고 싶었다”고 말했다.

5가지 실험으로 확인된 ‘AI 비인간화 효과’

연구팀은 총 5개의 실험을 통해 ‘AI의 인간다움’이 현실 인간에 미치는 영향을 검증했다.

▲실험1(피험자 195명)

참가자들에게 ‘표현력이 풍부하게 춤추는 로봇 영상’과 ‘기계적으로 파쿠르를 하는 로봇 영상’을 각각 보여줬다.

그 뒤, 직원 복리후생을 해치는 가상의 직장 시나리오(예: 휴식 대신 대체식 제공, 모든 행동 추적 장치 부착 등)에 대한 지지 여부를 조사했다.

결과적으로 춤추는 로봇을 본 그룹은 로봇에 마음이 있다고 느끼는 동시에, 직장에서의 비인간적 조치를 더 쉽게 수용하는 경향을 보였다.

▲실험2(피험자 451명)

동일한 로봇 영상을 보여준 뒤, 로봇의 능력을 ‘인간 수준’ 또는 ‘초인적 수준’이라고 각각 설명했다.

인간 수준으로 설명된 그룹은 실제 인간을 더 비인간적으로 평가했지만, 초인적 능력을 가진다고 들은 그룹은 인간성을 더 높게 평가했다.

즉, AI가 인간과 겹쳐 보일 때 인간에 대한 평가가 낮아지고, 명백히 다른 존재로 보일 때는 오히려 인간성이 강화되는 결과가 나타났다. 이는 기계가 명백하게 인간과는 다른 범주에 존재할 경우 자신들의 인간성을 보다 강화할 것임을 시사한다고 연구원은 설명했다.

▲실험3(피험자 651명)

세 그룹에 각각 ‘감정에 반응하는 가상 치료 프로그램’, ‘데이터 분석 의료 프로그램’, ‘단순 설문 분석 프로그램’ 중 하나의 설명문을 읽게 했다.

그 결과 '가상 치료 프로그램'을 읽은 피험자만이 인간의 비인간화를 증대시켰다. 이는 AI나 로봇이 감정적인 능력을 갖고 있는지 여부가 비인간화 프로세스의 방아쇠가 된다는 것을 보여준다. 즉, 감정에 반응하는 AI를 접한 그룹만 인간을 더 비인간적으로 평가했다.

▲실험4(피험자 280명)

참가자들에게 ‘AI가 뛰어난 감정 능력을 가진다’ 또는 ‘AI의 감정 능력은 한계가 있다’는 기사를 읽게 했다.

이후 아마존의 열악한 노동 환경 기사도 읽게 하고, 아마존 또는 코스트코 기프트카드 중 선택하게 했다.

그 결과 AI의 감정 능력을 긍정적으로 읽은 그룹은 인간성을 낮게 평가하며, 아마존의 열악한 환경에도 큰 불쾌감을 느끼지 않고 아마존 기프트카드를 선택하는 경향을 보였다.

▲실험5(피험자 331명)

참가자들에게 고객 상담용 가상 비서에 대한 설명을 제시했다. 한쪽은 ‘높은 감정적 능력을 지녔다’고 설명했고, 다른 쪽은 ‘순수한 기계적 기능만 있다’고 설명했다.

이후 지급된 소액 보너스를 인간 직원의 정신건강 지원 모금에 기부할지 물었다.

그 결과 감정적 지능을 가진 AI 설명을 들은 그룹은 AI를 더 인간적으로 보았지만, 실제 인간 직원을 돕기 위한 기부에는 인색했다.

AI의 인간화가 부르는 위험

김혜 연구원은 학술 매체 싸이포스트와의 인터뷰에서 “AI의 사회·감정적 능력을 높게 인식할수록, 우리는 실제 인간을 기계적으로 대하고 경의를 덜 표하게 될 수 있다"면서 "AI와 함께하는 기회가 늘어날수록, 현장에서 일하는 직원들이 무의식적으로 더 학대받는 상황이 생길 수 있다”고 우려했다.

연구팀은 이번 연구에서 다루지 못한 의문도 제기했다.

관련기사

- 만약 전세계 사람들이 동시에 불을 켠다면?2025.08.17

- 뉴욕 거리에 존재하는 모든 문자 검색했더니2025.08.15

- 스마트워치 '수면 측정' 믿고 써도 될까2025.07.13

- "악몽 자주 시달리면 더 빨리 늙고 죽는다"2025.07.06

감정적 능력을 가진 AI와 교류하는 경험이 자기 자신을 비인간적으로 여기게 만들 가능성이 있는지 여부다. 또 직장에서 고도화된 AI가 활용될 경우, 인간 직원들이 스스로를 더 비인간적으로 받아들일지, 혹은 타인을 비인간화하면서도 자기 인간성은 강화될지 여부도 향후 연구 과제다.

김 연구원은 "AI가 일상에 점점 깊숙이 파고드는 만큼, 그 영향이 시간에 따라 어떻게 변화하는지를 이해하는 것이 중요하다"면서 "최종적으로는 AI가 인간적 가치를 해치지 않고, 오히려 증진시킬 수 있도록 책임 있는 설계와 활용이 필요하다"고 강조했다.