"AMD가 추구하는 ROCm은 단순한 AI 라이브러리가 아니라 개방성과 포용성을 담은 하나의 철학이다. 특정 활용 사례에 대해 솔루션을 공급하거나 제시하지는 않으며 모든 것을 갖추지도 않았다. 그러나 AMD와 함께 하는 개발자와 AI의 미래를 만들 수 있다."

지난 12일 오전 국내 기자단과 온라인으로 진행한 인터뷰에서 아누쉬 엘랑고반 AMD AI 소프트웨어 부문 총괄부사장은 AI 기술 개발 방향에 대해 이같이 설명했다.

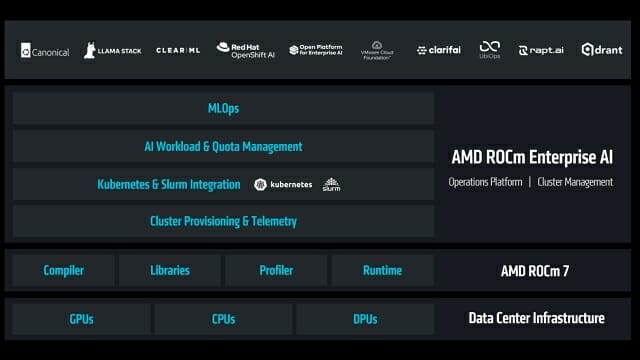

ROCm은 AMD 인스팅트와 라데온 GPU를 활용해 AI 관련 처리를 수행할 수 있는 오픈소스 기반 프레임워크다. 2022년 2월 첫 버전인 ROCm 5가 출시됐고 올해 9월 출시된 ROCm 7에는 성능 향상과 인스팅트 MI350 등 새 하드웨어 지원을 추가했다.

이날 아누쉬 엘랑고반 총괄부사장은 "ROCm은 오픈소스 기반으로 누구나 커뮤니티에 기여해 성능과 효율을 높일 수 있다. 엔비디아 쿠다(CUDA), 인텔 원API 등 경쟁사의 폐쇄적인 프레임워크 대비 개선점을 모두 누릴 수 있다"고 강조했다.

"ROCm 7, 성능·확장성 강화"

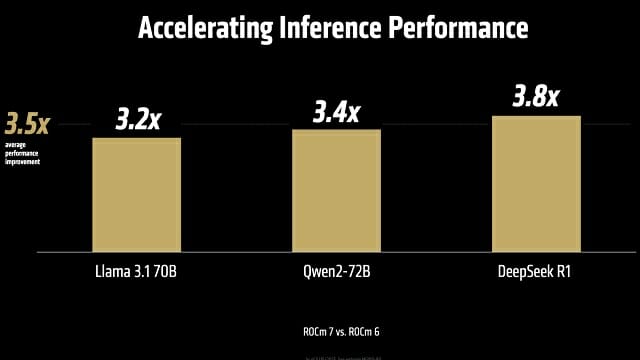

ROCm 7은 2023년 12월 공개된 ROCm 6 대비 추론 성능을 크게 강화했다. 메타 라마 3.1 700B 모델 연산 성능은 3.8배, 딥시크 R1은 3.4배 향상됐다. 또 단일 노드부터 멀티 노드·클러스터까지 분산 추론과 학습이 가능하도록 확장했다.

아누쉬 엘랑고반 총괄부사장은 "성능 향상은 알고리듬, 오퍼레이터, 커널 퓨전 등 소프트웨어 스택 전반에서 최적화를 진행한 결과이며 동일한 하드웨어에서도 추론과 학습 성능이 눈에 띄게 개선됐다. 전력 효율과 총소유비용(TCO) 측면에서도 경쟁력을 확보했다"고 설명했다.

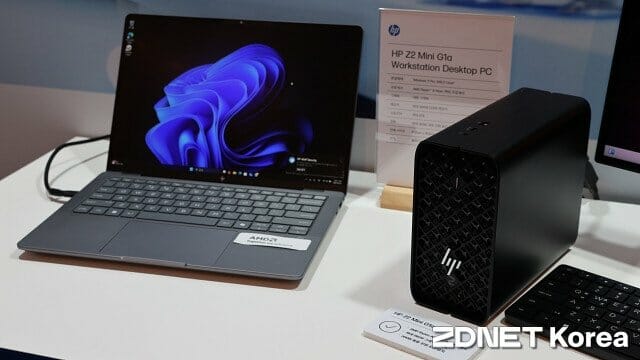

서버용 인스팅트 GPU 뿐만 아니라 라데온 RX 등 RDNA 아키텍처 기반 GPU, 노트북용 라이젠 맥스에 포함된 GPU도 지원한다. 모바일 워크스테이션이나 노트북에서도 클라우드 없는 거대언어모델(LLM) 추론이 가능해졌다.

"최신 AI 모델 개발 단계부터 협업, 출시 당일 지원"

AMD는 ROCm의 성능과 호환성을 강화하기 위해 새 AI 모델 출시 당일부터 이를 지원하는 '데이제로'(Day-0) 모델 지원을 내세웠다.

아누쉬 엘랑고반 총괄부사장은 "오픈AI, 메타, 딥시크 등 주요 AI 모델 개발사와 협력을 강화하고 있다. 내부 조직인 '프론티어 랩'을 중심으로 모델 설계 단계부터 협력해 출시 당일부터 AMD GPU를 활용할 수 있도록 했다"고 밝혔다.

이어 "출시 이후에는 성능 최적화와 미세 조정을 위한 소프트웨어 도구를 개발자와 실사용자에게 공급한다"고 설명했다.

ROCm의 개방성은 vLLM, SGLANG, 파이토치 등 주요 오픈소스 프레임워크와의 빠른 통합으로 이어지고 있다.

아누쉬 엘랑고반 부사장은 "폐쇄적인 생태계보다 훨씬 빠르게 진화하며 조그만 개선이 모든 사람에게 긍정적인 영향을 미친다는 점이 ROCm의 가장 큰 강점"이라고 말했다.

우분투 리눅스 통합·윈도 운영체제 지원 강화

AMD는 이달 초 우분투 리눅스를 관리하는 캐노니컬과의 협력을 통해 ROCm을 우분투에 공식 통합했다. 아누쉬 엘랑고반 부사장은 "과거 우분투 커뮤니티에서 프로젝트 중심으로 지원하던 것과 달리 이제는 명령어 한 줄로 쉽게 설치할 수 있다"고 설명했다.

ROCm 최초 출시 이후 수 차례 지적됐던 윈도 운영체제 호환성도 ROCm 7 출시 이후 개선됐다. 아누쉬 엘랑고반 부사장은 "ROCm에서 윈도 운영체제는 1등 시민이며 AMD 역시 윈도 지원을 중요하게 여기고 있다"고 설명했다.

최신 기능을 가장 빨리 통합하는 나이틀리(nightly) 빌드가 리눅스와 윈도 운영체제용으로 모두 제공된다. 윈도 환경에서 ROCm과 AMD GPU를 활용하려는 개발자들이 이를 활용해 개발 과정을 단축할 수 있게 됐다.

국내 AI 스타트업과 ROCm 생태계 확대 위한 협업 강화

AMD는 ROCm 생태계 확장과 관련해 AI 스타트업 '모레'(Moreh), 카카오엔터프라이즈, 망고부스트 등 국내 기업과도 협업을 강화하고 있다.

카카오엔터프라이즈는 지난 6월 4세대 에픽 프로세서 기반 클라우드 컴퓨팅 서비스 'BCS m3az' 인스턴스를 출시하고 추론·학습 환경 모두에서 성능 최적화·비용 효율화를 달성했다.

아누쉬 엘랑고반 부사장은 "망고부스트가 인스팅트 MI300X GPU와 ROCm을 활용해 개발한 AI 추론 최적화 소프트웨어 '망고 LLM부스트'는 글로벌 AI 성능 평가 벤치마크인 ML퍼프(MLPerf) 추론 5.0에서 새로운 기록을 달성하기도 했다"고 소개했다.

개발자 클라우드로 접근성 강화..."더 다양한 곳에서 쓰이기 희망"

AMD는 고성능 CPU·GPU 접근이 어려운 스타트업이나 학생 등 개발자 대상으로 별도 개발자 클라우드도 운영하고 있다. 개발자와 오픈소스 기여자에게는 일정 시간을 무료로 쓸 수 있는 크레딧을 제공한다.

관련기사

- AMD, 인프라 시장 겨냥 에픽 임베디드 2005 프로세서 출시2025.12.10

- "AI 데이터센터 혁신"…HPE, AMD·브로드컴 손잡고 '헬리오스' AI 랙 출시2025.12.04

- 슈퍼마이크로, 'AMD MI355X' 탑재 공냉식 서버 출시…AI 포트폴리오 확대2025.11.20

- 리사 수 AMD CEO "MI355 GPU 양산 예정대로 진행중"2025.11.05

아누쉬 엘랑고반 총괄부사장은 "누구나 깃허브 계정만 있으면 인스팅트 GPU를 체험할 수 있도록 지원하고, 교육 프로그램·해커톤·대학 협업을 통해 ROCm 전문 인력 양성에도 힘을 쏟고 있다"고 설명했다.

이어 "AMD 하드웨어가 많은 곳에서 쓰이는 것처럼 ROCm도 보다 다양한 곳에서 쓰이길 바란다. 저수준 하드웨어부터 엔터프라이즈급 클러스터를 통한 추론, 배포 등 누구나 선호하는 개방형 AI 스택으로 만드는 것이 목표"라고 덧붙였다.