인공지능(AI) 기술이 빠르게 발전하면서 인터넷 콘텐츠의 ‘신뢰성’이 심각한 위기를 맞고 있다.

유튜브 교육 채널 ‘커지저트(Kurzgesagt)’는 최근 영상을 통해 “AI가 만들어내는 저품질 정보가 결국 인터넷의 신뢰 체계를 무너뜨릴 수 있다”고 경고했다. 이 영상은 게시된 지 약 이틀만에 600만 조회수를 넘어, IT 미디어인 기가진 등 외신을 통해서도 소개됐다.

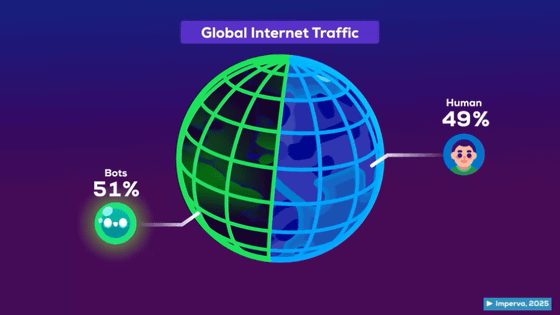

인터넷의 절반은 ‘봇’… AI가 만든 콘텐츠 쏟아져

이 외신에 따르면 현재 전 세계 인터넷 트래픽의 절반가량은 인간이 아닌 ‘봇(bot)’이 만들어내는 것으로 알려졌다. 특히 최근에는 AI가 자동으로 생성한 글, 영상, 심지어 책까지 무분별하게 확산되며, 이른바 'AI 슬럽'(AI Slop, AI가 만든 저품질 콘텐츠) 현상이 심각한 문제로 떠오르고 있다.

이 같은 현상은 검색 엔진의 신뢰도에도 영향을 주고 있다.

대표적으로 구글의 'AI 요약'(AI Overview) 기능은 빠른 응답을 위해 경량화된 모델을 사용하는데, 이 때문에 사실과 다른 정보가 표시되는 사례가 잇따르고 있다. 실제로 자신의 이름을 검색했더니 “10년 전에 사망했다”는 잘못된 문장이 등장하거나, AI가 잘못된 정치 성향을 덧씌운 사례도 보고됐다.

"AI가 만들어낸 80%는 맞지만, 나머지 20%는 근거조차 없다"

커지저트 제작진은 학술 콘텐츠를 만들 때 최소 2~3명의 검증 과정을 거쳐 전문가 피드백을 받는 등, 한 편당 100시간 이상을 사실 확인에 투자한다고 밝혔다.

제작팀은 정보 수집 과정에 AI를 도입해 실험을 진행했다. 그 결과, AI가 제공한 정보의 약 80%는 실제 출처가 존재하고 요약도 비교적 정확했지만, 나머지 20%는 출처조차 알 수 없는 허위 정보였다고 한다.

커지저트는 이 현상을 “AI가 우리를 만족시키기 위해 사실을 꾸며냈다”고 지적했다. 즉, AI가 ‘더 흥미롭게 보이도록’ 일부 내용을 창작한 것이다.

문제는 이 ‘80%의 신뢰할 만한 정보’조차 완전히 안전하지 않다는 점이다. 커지저트 팀이 출처를 다시 추적한 결과, 일부 뉴스 사이트는 AI가 만든 근거 없는 정보를 실제 뉴스처럼 게시하고 있었고, 이후 다른 AI가 이를 학습해 '출처가 있는 정보'로 다시 내보내는 ‘허위 정보의 순환 구조’가 확인됐다.

관련기사

- AI가 엉뚱한 말을 하는 이유?…오픈AI가 찾은 '근본 원인'2025.09.08

- 오픈AI, 기술적 한계 왔나…'o3' 등 최신 추론 AI 모델 '환각' 더 심해져2025.04.20

- 국민 10명 중 4명 "딥페이크 가짜뉴스 판별 어렵다”2024.12.09

- 과방위 국감 핵심 쟁점은..."온라인 가짜뉴스·해킹·인재유출"2025.09.12

실제로 올해 기준, 1천200개 이상의 뉴스·웹사이트가 AI가 만든 가짜 기사나 허위 스토리를 게시한 사실이 드러났다. 즉, AI가 만든 가짜 정보를 실제 언론사 기자가 받아쓰고, 그것을 다시 AI가 학습하는 악순환이 벌어지고 있는 셈이다.

커지저트는 영상 말미에서 “AI의 확산은 인터넷의 신뢰 체계를 되돌릴 수 없게 파괴할 위험을 내포하고 있다”고 경고했다. AI가 생산하는 정보의 양이 폭발적으로 늘어나면서, 진짜와 가짜를 구별하기 점점 어려워지는 상황이 펼쳐지고 있다는 지적이다.