…국내 연구진이 AI비전 인식률을 기존 대비 4.7%개선할 수 있는 기술을 개발했다.

광주과학기술원(GIST, 총장 임기철)은 AI융합학과 이규빈 교수 연구팀이 오류 추정을 통해 미학습 물체의 인식 결과를 정제하는 AI모델, '큐버'(QuBER)를 개발했다고 14일 밝혔다.

'큐버'는 실시간으로 학습 데이터에 포함되지 않은, 오탐지된 물체를 삭제하거나 추가하는 기능을 갖췄다.

현재 널리 사용되는 AI 비전 기술에는 몇 가지 한계가 있다. 2018년 공개된 마스크 R-CNN 모델은 사전에 학습된 물체만 인식할 수 있다. 2023년 나온 '세그멘트 애니싱' 모델은 임의 탐지는 가능하지만, 복잡한 환경에서 정확도가 크게 떨어진다.

이 같은 단점을 보완한 모델이 GIST '큐버'다. 기존대비 인식률이 4.7%가량 개선됐다.

'큐버'는 RGB-D(컬러+깊이) 이미지와 초기 예측 데이터를 활용해 ‘4자 경계 오류’를 분석, 물체 인식의 정확도를 높이는 것이 특징이다.

이 기술을 통해 처음 보는 미학습 물체도 실시간 빠르고 정확하게 인식할 수 있다.

'4자 경계 오류'는 AI의 초기 예측값과 실제 데이터 간 차이를 올바르게 검출된 경계 검출해야 했지만 놓친 경계 잘못 검출한 경계 검출하지 않아야 할 부분을 정확히 비검출한 경계 등을 말한다.

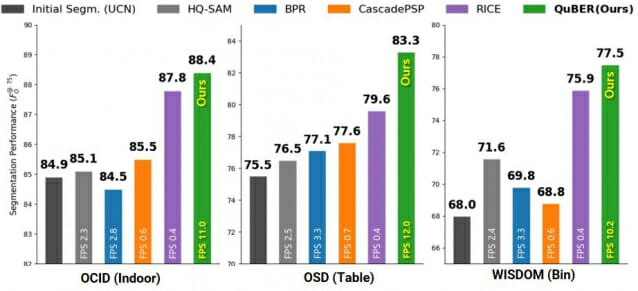

연구팀은 ▲실내 환경(OCID)에서 88.4%의 인식률 ▲테이블 위 물체들(OSD)에서 83.3%의 정확도 ▲상자 안의 복잡한 물체들(WISDOM)에서 77.5%의 정확도를 보였다고 설명했다.

관련기사

- 이재명 첫 공식일정은 퓨리오사AI..."새로운 희망 보인다"2025.04.14

- "제품·정보 없는데"…오픈AI 공동창업자 스타트업, 신뢰만으로 '45조원' 평가2025.04.14

- 다쏘시스템-아헨공대, 3DX로 차세대 엔지니어 양성2025.04.14

- "자본주의, 디지털 공유제로 진화중…규제완화보다 적절한 규제가 더 효과"2025.04.08

이규빈 교수는 “로봇이 처음 보는 물체도 정확하고 효율적으로 인식할 수 있다는 가능성을 확인했다”며, “이 기술이 다양한 로봇 작업에 적용돼 새로운 환경에서도 안정적으로 동작하는 로봇 개발에 큰 역할을 할 것”이라고 기대감을 나타냈다.

연구는 산업통상자원부와 과학기술정보통신부 지원을 받았다. 백승혁 박사가 박사과정 재학 중 수행했다. 연구결과는 오는 5월 열리는 로봇 분야 국제 학회인 IEEE 국제 로봇 자동화 학술대회(ICRA)에서 발표한다.