KAIST(총장 이광형)는 전기및전자공학부 김주영 교수 연구팀이 챗GPT 같은 거대 언어 모델의 추론 연산을 효율적으로 가속하는 AI 반도체를 개발했다고 4일 밝혔다.

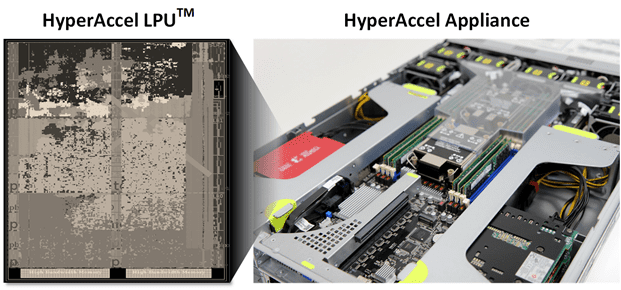

연구팀이 개발한 AI 반도체 'LPU(Latency Processing Unit)'는 메모리 대역폭 사용을 극대화하고 추론에 필요한 모든 연산을 고속으로 수행 가능한 연산 엔진을 갖춘 AI 반도체다. 자체 네트워킹을 내장해 여러 개 가속기로 쉽게 확장할 수 있다.

이 LPU 기반 가속 어플라이언스 서버는 거대 AI 모델 학습에 많이 쓰이는 고성능 GPU인 엔비디아 A100 기반 슈퍼컴퓨터보다 성능은 최대 50%, 가격 대비 성능은 2.4배가량 높다고 연구진은 밝혔다. 생성형 AI 서비스 수요가 증가하고 있는 데이터센터에서 고성능 GPU를 대체할 수 있으리란 기대다.

관련기사

- 美, AI칩 中 수출규제 확대 검토…엔비디아·AMD 진땀2023.06.28

- 삼성·SK도 '챗GPT'에 주목...AI 반도체 개발 집중2023.02.16

- 삼성전자 DX부문 노조, 공동투쟁 철회…"전체 조합원 권익 의견 반영 안돼"2026.05.04

- 美 FCC, 중국 내 전자제품 시험 금지 추진…"아이폰도 영향권"2026.05.04

이 연구는 김주영 교수가 창업한 하이퍼엑셀에서 수행했다. 최근 미국 샌프란시스코에서 열린 국제 반도체 설계 자동화 학회(DAC, Design Automation Conference)에서 공학 부문 최고 발표상(Engineering Best Presentation Award)을 수상했다.

KAIST 김주영 교수는 "거대 언어 모델의 추론에 필요한 막대한 비용을 획기적으로 절감할 수 있는 AI 반도체 솔루션으로 세계 무대에서 인정받은 것"이라며 "미래 거대 인공지능 연산을 위한 새로운 프로세서 LPU로 글로벌 시장을 개척하고, 빅테크 기업들의 기술력보다 우위를 선점하겠다"라고 밝혔다.