최근 인공지능(AI) 챗봇 '이루다'로 혐오, 차별 조장 등 AI가 사회의 비윤리적 행태를 습득, 확산시킬 수 있다는 우려가 나타난 상황이다. 이에 대해 AI 개발자, 사용자 모두의 입장을 고려한 윤리 기준 및 점검사항을 구체화하고, 관련 교육 체계와 거버넌스 정립이 시급하다는 의견이 각계에서 제기됐다.

2일 열린 '사람 중심의 AI 구현을 위한 정책 세미나'에서는 이같은 의견들이 등장했다.

이날 주제발표를 맡은 문정욱 정보통신정책연구원(KISDI) 센터장은 윤리적 AI 구현을 목적으로 마련할 수 있는 주체별 점검사항에 대해 주로 언급했다.

문정욱 센터장은 "현재 AI 윤리 기준의 확산과 정착을 위해 AI 생태계 참여 주체별 체크리스트를 마련하기 위해 선행사례를 수집하고, 조사하는 연구 단계"라고 밝혔다.

해외 선행사례들로는 ▲유럽연합(EU)의 '신뢰할 수 있는 AI를 위한 자체 평가 목록' ▲영국 ICO 'AI 및 데이터 보호 안내지침' ▲마이크로소프트(MS) 'AI 공정성 체크리스트' ▲카네기멜론 대학 SW공학연구소 '윤리적 AI 설계 체크리스트' 등을 소개했다.

문 센터장은 "타 AI 윤리 체크리스트들과 각계 의견을 살펴볼 때 우선 무엇을 위해 점검하는지, '목적의 명확화'가 이뤄져야 할 것"이라며 "관련 주체의 범위와 AI가 야기한 결과와 책임의 명확성도 풀어야 할 과제"라고 말했다.

이어 "프라이버시나 투명성 등 윤리 기준 간의 상충 문제도 해결책을 모색해야 한다"며 "현업에서 참고할 수 있을 만큼 구체적이면서도, 산업 발전을 저해하지 않는 수준에서 논의가 지속돼야 한다"고 덧붙였다.

'인공지능 윤리 교육의 방향과 도전'이란 주제로 발표한 변순용 서울교육대학교 교수는 국내 AI 교육이 기술 교육에만 집중돼 있다는 점을 꼬집었다.

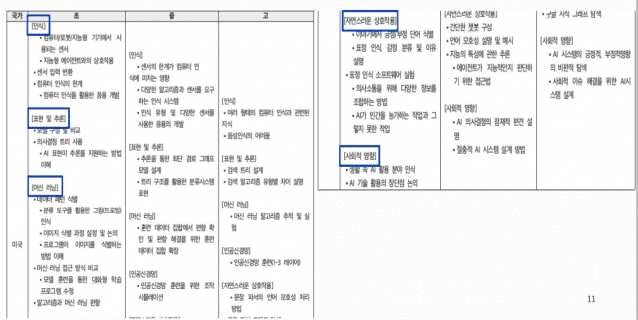

미국, 핀란드, 호주의 경우 AI가 사회에 미치는 영향과 관련 철학, AI와 인간의 상호작용 등 다양한 인문학적 고려를 반영한 교육을 실시하고 있는 반면, 우리나라와 중국의 경우 코딩 프로그램과 각종 신기술 체험 중심으로 교육과정이 구성돼 있다는 것. 학교에서 제공되는 교육뿐 아니라, 교육을 제공하는 교사 대상 교육에서도 이같은 특징이 드러난다는 진단이다.

이에 대해 변순용 교수는 AI 전문가나 개발자가 아닌, 국민 모두에 필요한 AI 교육이 필요하다고 강조했다. MIT 미디어랩에서 실시하는 AI 윤리교육과 하버드 대학교의 내재된 윤리 프로그램 등을 사례로 들었다.

향후 이런 AI 윤리 기준을 다루는 교육과정을 마련할 때, 국가의 사회적 특성을 고려해야 한다고 조언했다. 변 교수는 "세계적 가이드라인이나 기준을 그대로 들여오면 일반적이나 추상적인 내용으로 받아들여질 수밖에 없다"며 우리나라에서 발표된 'AI 윤리 기준'의 3대 기본 원칙과 10대 요건을 반영한 AI 윤리 교육 체계 개발을 제안했다.

관련기사

- 혐오발언 AI를 수출할 수 있을까?...AI윤리, 선택아닌 필수2021.02.01

- AI 개인정보 보호수칙 마련…'이루다 재발' 막는다2021.01.26

- '이루다' 학습효과?...금융업계, 챗봇 단도리에 적극 나서2021.01.21

- 사람이 되고픈 꿈 못 이룬 ‘이루다’2021.01.15

김정원 과학기술정보통신부 정보통신정책실장은 "작년 AI 윤리 기준을 마련했는데 올해는 더 나아가 우리 사회 AI 윤리 기준 정립하는 등 다양한 실천방안을 추진할 계획"이라며 "올해 중 각 주체별 AI 윤리 점검사항을 마련하고, 초·중·고·대학원생별 AI 윤리 교육도 마련할 계획"이라고 말했다.

이어 "AI의 편향성을 완화하고 신뢰성 검증할 수 있는 기술도 적극 준비하면서 자율규제 환경을 조성하기 위한 법제 검토도 추진해나가겠다"고 덧붙였다.